Математическое ожидание и дисперсия являются важными характеристиками случайного процесса, но они не дают достаточного представления о том, какой характер будут иметь отдельные реализации случайного процесса. Это хороню видно из рис. 9.3, где показаны реализации двух случайных процессов, совершенно различных по своей структуре, хотя и имеющих

одинаковые значения математического ожидания и дисперсии. Штриховыми линиями на рис. 9.3 показаны значения для случайных процессов.

Процесс, изображенный на рис. 9.3, а, от одного сечения к другому протекает сравнительно плавно, а процесс на рис. 9.3, б обладает сильной изменчивостью от сечения к сечению Поэтому статистическая связь между сечениями в первом случае больше, чем во втором, однако ни по математическому ожиданию, ни по дисперсии этого установить нельзя.

Чтобы в какой-то мере охарактеризовать внутреннюю структуру случайного процесса, т. е. учесть связь между значениями случайного процесса в различные моменты времени или, иными словами, учесть степень изменчивости случайного процесса, необходимо ввести понятие о корреляционной (автокорреляционной) функции случайного процесса.

Корреляционной функцией случайного процесса называют неслучайную функцию двух аргументов которая для каждой пары произвольно выбранных значений аргументов (моментов времени) равна математическому ожиданию произведения двух случайных величин соответствующих сечений случайного процесса:

где - двумерная плотность вероятности; - центрированный случайный процесс; - математическое ожидание (среднее значение) случайного процесса.

Различные случайные процессы в зависимости от того, как изменяются их статистические характеристики с течением времени, делят на стационарные и нестационарные. Разделяют стационарность в узком смысле и стационарность в широком смысле.

Стационарным в узком смысле называют случайный процесс если его n-мерные функции распределения и плотности вероятности при любом не зависят от сдвига всех точек

Вдоль оси времени на одинаковую величину т. е.

Это означает, что два процесса имеют одинаковые статистические свойства для любого т. е. статистические характеристики стационарного случайного процесса неизменны во времени.

Стационарный случайный процесс - это своего рода аналог установившегося процесса в детерминированных системах. Любой переходный процесс не является стационарным.

Стационарным в широком смысле называют случайный процесс математическое ожидание которого постоянно:

а корреляционная функция зависит только от одной переменной - разности аргументов при этом корреляционную функцию обозначают

Процессы, стационарные в узком смысле, обязательно стационарны и в широком смысле; однако обратное утверждение, вообще говоря, неверно.

Понятие случайного процесса, стационарного в широком смысле, вводится тогда, когда в качестве статистических характеристик случайного процесса используются только математическое ожидание и корреляционная функция. Часть теории случайных процессов, которая описывает свойства случайного процесса через его математическое ожидание и корреляционную функцию, называют корреляционной теорией.

Для случайного процесса с нормальным законом распределения математическое ожидание и корреляционная функция полностью определяют его n-мерную плотность вероятности.

Поэтому для нормальных случайных процессов понятия стационарности в широком и узком смысле совпадают.

Теория стационарных процессов разработана наиболее полно и позволяет сравнительно просто производить расчеты для многих практических случаев. Поэтому допущение о стационарности иногда целесообразно делать также и для тех случаев, когда случайный процесс хотя и нестационарен но на рассматриваемом отрезке времени работы системы статистические характеристики сигналов не успевают сколько-нибудь существенно измениться. В дальнейшем, если не будет оговорено особо, будут рассматриваться случайные процессы, стационарные в широком смысле.

При изучении случайных процессов, стационарных в широком смысле, можно ограничиться рассмотрением только процессов с математическим ожиданием (средним значением), равным нулю, т. е. так как случайный процесс с ненулевым математическим ожиданием представляют как сумму процесса с нулевым математическим ожиданием и постоянной неслучайной (регулярной) величиной, равной математическому ожиданию этого процесса (см. далее § 9.6).

При выражение для корреляционной функции

В теории случайных процессов пользуются двумя понятиями средних значений. Первое понятие о среднем значении - это среднее значение по мнооюеству (или математическое ожидание), которое определяется на основе наблюдения над множеством реализацчй случайного процесса в один и тот же момент времени. Среднее значение по множеству принято обозначать волнистой чертой над выражением, описывающим случайную функцию:

В общем случае среднее значение по множеству является функцией времени

Другое понятие о среднем значении - это среднее значение по времени, которое определяется на основе наблюдения за отдельной реализацией случайного процесса на протяжении

достаточно длительного времени Т. Среднее значение по времени обозначают прямой чертой над соответствующим выражением случайной функции и определяют по формуле:

если этот предел существует.

Среднее значение по времени в общем случае различно для отдельных реализаций множества, определяющих случайный процесс. Вообще говоря, для одного и того же случайного процесса среднее по множеству и среднее по времени значения различны. Однако существует класс стационарных случайных процессов, называемых эргодическими, для которых среднее по множеству равно среднему по времени, т. е.

Корреляционная функция эргодического стационарного случайного процесса неограниченно убывает по модулю при

Однако надо иметь в виду, что не всякий стационарный случайный процесс является эргодическим, например случайный процесс каждая реализация которого постоянна во времени (рис. 9.4), является стационарным, но не эргодическим. В этом случае средние значения, определенные по одной реализации и в результате обработки множества реализаций, не совпадают. Один и тот же случайный процесс в общем случае может быть эргодическим по отношению к одним статистическим характеристикам и неэргодическим по отношению к другим. В дальнейшем будем считать, что по отношению ко всем статистическим характеристикам условия эргодичности выполняются.

Свойство эргодичности имеет очень большое практическое значение. Для определения статистических свойств некоторых объектов, если трудно осуществить одновременное наблюдение за ними в произвольно выбранный момент времени (например, при наличии одного опытного образца), его можно заменить длительным наблюдением за одним объектом. Иными словами, отдельная реализация эргодического случайного

процесса на бесконечном промежутке времени полностью определяет весь случайный процесс с его бесконечными реализациями. Собственно говоря, этот факт лежит в основе описанного ниже метода экспериментального определения корреляционной функции стационарного случайного процесса по одной реализации.

Как видно из (9.25), корреляционная функция представляет собой среднее значение по множеству. Для эргодических случайных процессов корреляционную функцию можно определить как среднее по времени от произведения , т. е.

где - любая реализация случайного процесса; х - среднее значение по времени, определяемое по (9.28).

Если среднее значение случайного процесса равно нулю то

Основываясь на свойстве эргодичности, можно дисперсию [см. (9.19)] определить как среднее по времени от квадрата центрированного случайного процесса, т. е.

Сравнивая выражения (9.30) и (9.32) при можно установить очень важную связь между дисперсией и корреляционной функцией - дисперсия стационарного случайного процесса равна начальному значению корреляционной функции:

Из (9.33) видно, что дисперсия стационарного случайного процесса постоянна, а следовательно, постоянно и среднее квадратическое отклонение:

Статистические свойства связи двух случайных процессов можно характеризовать взаимной корреляционной функцией которая для каждой пары произвольно выбранных значений аргументов равна

Для эргодических случайных процессов вместо (9.35) можно записать

где - любые реализации стационарных случайных процессов соответственно.

Взаимная корреляционная функция характеризует взаимную статистическую связь двух случайных процессов в разные моменты времени, отстоящие друг от друга на промежуток времени . Значение характеризует эту связь в один и тот же момент времени.

Из (9.36) следует, что

Если случайные процессы статистически не связаны друг с другом и имеют равные нулю средние значения, то их взаимная корреляционная функция для всех равна нулю. Однако обратный вывод о том, что если взаимная корреляционная функция равна нулю, то процессы независимы, можно сделать лишь в отдельных случаях (в частности, для процессов с нормальным законом распределения), общей же силы обратный закон не имеет.

Заметим, что корреляционные функции могут вычисляться и для неслучайных (регулярных) функций времени. Однако когда говорят о корреляционной функции регулярной функции то под этим понимают просто результат формального

применения к регулярной функции операции, выражаемой интегралом:

Приведем некоторые основные свойства корреляционных функций

1. Начальное значение корреляционной функции [см. (9.33)] равно дисперсии случайного процесса:

![]()

2. Значение корреляционной функции при любом не может превышать ее начального значения, т. е.

Чтобы доказать это, рассмотрим очевидное неравенство из которого следует

Находим средние значения по времени от обеих частей последнего неравенства:

Таким образом, получим неравенство

3. Корреляционная функция есть четная функция , т. е.

Это вытекает из самого определения корреляционной функции. Действительно,

поэтому на графике корреляционная функция всегда симметрична относительно оси ординат.

4. Корреляционная функция суммы случайных процессов определяется выражением

где - взаимные корреляционные функции

Действительно,

5. Корреляционная функция постоянной величины равна квадрату этой постоянной величины (рис. 9.5, а), что вытекает из самого определения корреляционной функции:

6. Корреляционная функция периодической функции, например представляет собой косинусоиду (рис. 9-5, 5), т. е.

имеющую ту же частоту что и и не зависящую от сдвига фазы

Чтобы доказать это, заметим, что при нахождении корреляционных функций периодических функций можно использовать следующее равенство:

где - период функции

Последнее равенство получается после замены интеграла с пределами от -Т до Т при Т со суммой отдельных интегралов с пределами от до , где и использования периодичности подынтегральных функций.

Тогда, учитывая сказанное выше, получим т.

7. Корреляционная функция временной функции, разлагаемой в ряд Фурье:

Рис. 9.5 (см. скан)

имеет на основании изложенного выше следующий вид:

8. Типичная корреляционная функция стационарного случайного процесса имеет вид, представленный на рис. 9.6. Ее можно аппроксимировать следующим аналитическим выражением:

С ростом связь между ослабевает и корреляционная функция становится меньше. На рис. 9.5, б, в приведены, например, две корреляционные функции и две соответствующие им реализации случайного процесса. Легко заметить, что корреляционная функция, соответствующая случайному процессу с более тонкой структурой, убывает быстрее Другими словами, чем более высокие частоты присутствуют в случайном процессе, тем быстрее убывает соответствующая ему корреляционная функция.

Иногда встречаются корреляционные функции, которые могут быть аппроксимированы аналитическим выражением

где - дисперсия; - параметр затухания; - резонансная частота.

Корреляционные функции подобного вида имеют, например, случайные процессы типа турбулентности атмосферы, фединга радиолокационного сигнала, углового мерцания цели и т. п. Выражения (9.45) и (9.46) часто используются для аппроксимации корреляционных функций, полученных в результате обработки экспериментальных данных.

9. Корреляционная функция Стационарного случайного процесса, на которой наложена периодическая составляющая с частотой также будет содержать периодическую составляющую той же частоты.

Это обстоятельство можно использовать как один из способов обнаружения «скрытой периодичности» в случайных процессах, которая может не обнаруживаться при первом взгляде на отдельные записи реализации случайного процесса.

Примерный вид корреляционной функции процесса содержащего в своем составе кроме случайной также и периодическую составляющую, показан на рис. 9.7, где обозначена корреляционная функция, соответствующая случайной составляющей. Чтобы выявить скрытую периодическую составляющую (такая задача возникает, например, при выделении малого полезного сигнала на фоне большой помехи), лучше всего определить корреляционную функцию для больших значений когда случайный сигнал уже сравнительно слабо коррелирован и случайная составляющая слабо сказывается на виде корреляционной функции.

06 Лекция.doc

Лекция 6. Корреляционные функции случайных процессовПлан.

1.Понятие корреляционной функции случайного процесса.

2.Стационарность в узком и в широком смыслах..

3.Среднее значение по множеству.

4.Среднее значение по времени.

5.Эргодические случайные процессы.

Математическое ожидание и дисперсия являются важными характерис-тиками случайного процесса, но они не дают достаточного представления о том, какой характер будут иметь отдельные реализации случайного процесса. Это хорошо видно из рис. 6.1, где показаны реализации двух случайных процессов, совершенно различных по своей структуре, хотя и имеющих одинаковые значения математического ожидания и дис-персии. Штриховыми линиями на рис. 6.1. показаны значения 3

x

(t

) для случайных процессов.

Процесс, изображенный на рис. 6.1, а,

от одного сечения к другому протекает сравнительно плавно, а процесс на рис. 6.1, б

обла-дает сильной изменчивостью от сечения к сечению. Поэтому статисти-ческая связь между сечениями в первом случае больше, чем во втором, однако ни по математическому ожиданию, ни по дисперсии этого уста-новить нельзя.

Чтобы в какой-то мере охарактеризовать внутреннюю структуру случайного процесса, т. е. учесть связь между значениями случай-ного процесса в различные моменты времени или, иными словами, учесть степень изменчивости случайного процесса, необходимо ввести понятие о корреляционной (автокорреляционной) функции случай-ного процесса.

^ Корреляционной функцией случайного процесса X (t ) называют не-случайную функцию двух аргументов R x (t 1 , t 2), которая для каждой пары произвольно выбранных значений аргументов (моментов времени) t 1 и t 2 равна математическому ожиданию произведения двух случайных величин X (t 1 ) и X (t 2 ) соответствующих сечений случайного процесса:

Где 2 (x 1 , t 1 ; x 2 , t 2) -двумерная плотность вероятности.

Часто пользуются иным выражением корреляционной функции, .записанной не для самого случайного процесса X (t ), а для центрированной случайной составляющей X (t ). Корреляционную функцию в этом случае называют центрированной и определяютиз соотношения

(6.2)

(6.2)

Различные случайные процессы в зависимости от того, как изме-няются их статистические характеристики с течением времени, делят на стационарные и нестационарные. Различают стационарность в уз-ком смысле и стационарность в широком смысле.

^ Стационарным в узком смысле называют случайный процесс X (t ), если его n -мерные функции распределения и плотность вероятности при любом п не зависят от положения начала отсчета времени t , т. е.

Это означает, что два процесса, X (t ) и X (t + ), имеют одинаковые статистические свойства для любого , т. е. статистические характерис-тики стационарного случайного процесса неизменны во времени. Стационарный случайный процесс - это своего рода аналог установивше-гося процесса в детерминированных системах.

^ Стационарным в широком смысле называют случайный процесс X (t ), математическое ожидание которого.постоянно:

А корреляционная функция зависит только от одной переменной - раз-ности аргументов =t 2 -t 1:

(6.5)

(6.5)

Понятие случайного процесса, стационарного в широком смысле,. вводится тогда, когда в качестве статистических характеристик слу-чайного процесса используются только математическое ожидание и корреляционная функция. Часть теории случайных процессов, кото-рая описывает свойства случайного процесса через его математическое ожидание и корреляционную функцию, называют корреляционной теорией.

Для случайного процесса с нормальным законом распределения математическое ожидание и корреляционная функция полностью опре-деляют его n -мерную плотность вероятности. Поэтому для нормальных случайных процессов понятия стационарности в широком и узком смыс-ле совпадают.

Теория стационарных процессов разработана наиболее полно и позволяет сравнительно просто производить расчеты для многих практических случаев. Поэтому допущение о стационарности иногда целесообразно делать также и для тех случаев, когда случайный процесс хотя и нестационарен, но на рассматриваемом отрезке времени работы системы статистические характеристики сигналов не успе-вают сколь-нибудь существенно измениться. В дальнейшем, если не будет оговорено особо, будут рассматриваться случайные процессы, стационарные в широком смысл.

В теории случайных процессов пользуются двумя понятиями средних значений. Первое понятие о среднем значении - это среднее зна-чение по множеству (или математическое ожидание), которое опреде-ляется на основе наблюдения над множеством реализации случайного процесса в один и тот же момент времени. Среднее значение по множе-ству принято обозначать волнистой чертой над выражением, описываю-щим случайную функцию:

В общем случае среднее значение по множеству является функцией времени.

Другое понятие о среднем значении - это среднее значение по времени, которое определяется на основе наблюдения за отдельной реализацией случайного процесса x { f ) на протяжении достаточно длительного времени Т. Среднее значение по времени обозначают прямой чертой над соответствующим выражением случайной функции и определяют по формуле

(6.7)

(6.7)

Если этот предел существует.

Среднее значение по времени в общем случае различно для отдельных реализации множества, определяющих случайный процесс.

Вообще для одного и того же случайного процесса среднее по множеству и среднее по времени различны, однако для так называемых эргодических стационарных случайных процессов среднее значение по множеству совпадает со средним значением по времени:

(6.8)

(6.8)

Равенство (6.8) вытекает из эргодической теоремы, в которой для некоторых стационарных случайных процессов доказано, что любая статистическая харак-теристика, полученная усреднением по множеству, с вероятностью, сколь угодно близкой к единице, совпадает с характеристикой, усредненной по времени. Эргодическая теорема доказана не для всех стационарных процессов, поэтому в тех случаях, где она еще не доказана, говорят об эргодической гипотезе.

Следует заметить, что не всякий стационарный процесс является эргодическим.

На рис. 6.2. изображен, например, график стационарного неэргодического процесса, для которого равенство (6.8) не выполняется. Один и тот же случай-ный процесс в общем случае может быть эргодическим по отношению к одним ста-тистическим характеристикам и не эргодическим по отношению к другим. В дальнейшем будем считать, что условия эргодичности для математического ожидания и корреляционной функции выполняются.

Физический смысл эргодической теоремы (или гипотезы) глубок и имеет большое практическое значение. Для определения статистических свойств эргодических стационарных процессов, если трудно осуществить одновременное на-блюдение за множеством подобных систем в произвольно выбранный момент вре-мени, например при наличии одного опытного образца, его можно заменить дли-тельным наблюдением за одной системой. Собственно говоря, этот факт лежит в основе экспериментального определения корреляционной функции стационар-ного случайного процесса по одной реализации. Наоборот, при наличии большой партии изделий массовой продукции для аналогичных исследований можно про-вести одновременное наблюдение за всеми образцами партии или их достаточно представительной выборкой.

Как видно из (6.5), корреляционная функция представляет собой среднее по множеству. В соответствии с эргодической теоремой для стационарного случайного процесса корреляционную функцию можно определить как среднее по времени от произведения x (t ) и x (t + ), т. е.

(6.9)

(6.9)

Где x (t )- любая реализация случайного процесса.

Центрированная корреляционная функция эргодического стацио-нарного случайного процесса

(6.10

(6.10

Между корреляционными функциями R x ( ) и R 0 x ( ) существует следующая связь:

R x ( )=R x 0 ( )+(x -) 2 , (6.11)

Основываясь на свойстве эргодичности, можно дисперсию D x [см. (19)] определить как среднее по времени от квадрата центрированного случайного процесса, т. е.

(6.12)

(6.12)

Сравнивая выражения (6.10) и (6.11), можно заметить, что диспер-сия стационарного случайного процесса равна начальному значению центрированной корреляционной функции:

(6.13)

(6.13)

Учитывая (6.12), можно установить связь между дисперсией и кор-реляционной функцией R x ( ), т. е.

Из (6.14) и (6.15) видно, что дисперсия стационарного случайного процесса постоянна, а следовательно постоянно и среднее квадратическое отклонение:

Статистические свойства связи двух случайных процессов X (t ) и G (t ) можно характеризовать взаимной корреляционной функцией R xg (t 1 , t 2), которая для каждой пары произвольно выбранных значений аргументов t 1 , t 2 равна

Согласно эргодической теореме, вместо (6.18) можно записать

(6.19)

(6.19)

Где x (t ) и g (t ) - любые реализации стационарных случайных процес-сов X (t ) и G (t ) соответственно.

Взаимная корреляционная функция R xg ( характеризует взаимную статистическую связь двух случайных процессов X (t ) и G (t ) в разные моменты времени, отстоящие друг от друга на промежуток времени т. Значение R xg (0) характеризует эту связь в один и тот же момент времени.

Из (6.19) следует,что

(6.20)

(6.20)

Если случайные процессы Х(t) и G (t ) статистическине связаны друг с другом и имеют равные нулю средние значения, то их взаимная корреляционная функция для всех т равна нулю. Однако обратный вывод о том, что если взаимная корреляционная функция равна нулю, то процессы независимы, можно сделать лишь в отдельных случаях (в частности, для процессов с нормальным законом распределения), общей же силы обратный закон не имеет.

Центрированная корреляционная функция R ° x ( для неслучайных функций времени тождественно равна нулю. Однако корреляционная функция R x ( может вычисляться и для неслучайных (регулярных) функций. Заметим, однако, что когда говорят о корреляционной функции регулярной функции x (t ), то под этим понимают просто результат формального применения к регулярной функции x (t ) опе-рации, выражаемой интегралом (6.13).

1. Математическое ожидание неслучайного процесса j(t ) равно самому неслучайному процессу:

Из выражения (1.9) следует, что любая центрированная неслучайная функция равна нулю, поскольку

2. Если случайная величина Y (t ) представляет собой линейную комбинацию функций X i (t ):

, (1.11)

, (1.11)

где - неслучайные функции t , то

. (1.12)

. (1.12)

Последнее соотношение следует из того, что операция определения математического ожидания линейна.

3. Корреляционная функция неслучайного процесса тождественно равна нулю. Это свойство следует непосредственно из (1.10).

4. Корреляционная функция не изменяется от прибавления к случайной функции любой неслучайной функции . Действительно, если ![]() , то

, то

Отсюда следует, что корреляционные функции случайных процессов и

Совпадают. Поэтому при определении корреляционных функций всегда можно считать, что рассматриваемый процесс является центрированным.

5. Если случайный процесс Y (t ) представляет собой линейную комбинацию случайных процессов X i (t ):

,

,

где - неслучайные функции, то

, (1.14)

, (1.14)

где - собственная корреляционная функция процесса X i (t ), - взаимная корреляционная функция процессов и .

Действительно:

, =

, =

.

.

Если случайные процессы попарно некоррелированы, то

. (1.15)

. (1.15)

Полагая в (1.14) , получим выражение для дисперсии линейной комбинации случайных процессов:

В частном случае некоррелированных случайных процессов

. (1.17)

. (1.17)

6. Корреляционная функция является неотрицательно определенной функцией:

. (1.18)

. (1.18)

Действительно, представим (1.18) в виде:

.

.

Так как интеграл есть предел интегральной суммы, то последнее выражение можно представить в виде предела суммы математических ожиданий, которая, в свою очередь, равна математическому ожиданию суммы. Поэтому операции интегрирования и математического ожидания можно менять местами. В результате получим:

7. Корреляционная функция симметрична относительно своих аргументов. Взаимная корреляционная функция этим свойством не обладает.

Симметричность корреляционной функции вытекает непосредственно из её определения:

В то же время для взаимной корреляционной функции имеем:

Взаимная корреляционная функция удовлетворяет следующему соотношению:

8. Корреляционная функция и взаимная корреляционная функция удовлетворяют следующим неравенствам:

Часто вместо собственной и взаимной корреляционных функций рассматривают нормированные корреляционные функции :

![]() , (1.23)

, (1.23)

![]() . (1.24)

. (1.24)

Нас основании (1.21) и (1.22) для нормированных корреляционных функций справедливы неравенства:

![]()

![]() . (1.25)

. (1.25)

Пример

Заданный случайных процесс представляет собой сумму случайного и неслучайного процессов: . Заданы ![]() , определить

, определить

Используя (1.9) и (1.12), будем иметь:

Согласно (1.15)

и, наконец, в соответствии с (1.17) ![]() .

.

КЛАССИФИКАЦИЯ СЛУЧАЙНЫХ ПРОЦЕССОВ

Стационарные процессы

Случайный процесс называется стационарным , если его многомерный закон распределения зависит лишь от взаимного расположения моментов времени t 1 , t 2 , . . .t n , т.е. не меняется при одновременном сдвиге этих моментов времени на одинаковые величины:

Если выражение (2.1) удовлетворяется при любом n , то такой процесс называется стационарным в узком смысле.

При n =1 выражение (2.1) приобретает вид:

И при ![]() , 2.2)

, 2.2)

т.е. одномерный закон распределения стационарного процесса не зависит от времени. Следовательно, от времени не будут зависеть и характеристики случайного процесса, зависящие от одномерного закона распределения: математическое ожидание и дисперсия случайного процесса:

,

,  . (2.3)

. (2.3)

При n =2 выражение (2.1) переписывается следующим образом:

Следовательно корреляционная функция стационарного процесса, определяемая двумерным законом распределения, будет зависеть лишь от интервала времени t

По определению А.Я.Хинчина процесс является стационарным в широком смысле , если условие стационарности (2.1) удовлетворяется лишь при n= 1 и 2.

Следовательно, условия стационарности процесса в широком смысле можно сформулировать в виде:

· математическое ожидание и дисперсия такого процесса не зависят от времени - и D X ;

· корреляционная функция процесса зависит лишь от интервала между сечениями по времени - .

K XX (t) является четной функцией своего аргумента:

|  |

||

Следует помнить, что взаимная корреляционная функция представляет собой нечетную функцию:

![]() , (

, (![]() ). (2.7)

). (2.7)

Нормальные процессы

Случайный процесс является нормальным , если нормальным является любой многомерный закон:

×  ), (2.8)

), (2.8)

где  (2.9)

(2.9)

Относительные собственные и взаимные корреляционные функции, и двух значениях случайной величины Y – y 1 и y 2 . Из рисунка видно, что математическое ожидание реализации при Y =y 1 равно y 1 , а при Y =y 2 – y 2 .

|

Рис.2.1. Пример стационарного неэргодического процесса

Таким образом, по единственной реализации стационарного, но неэргодического процесса нельзя судить о характеристиках процесса в целом.

Марковские процессы

Если вероятностные свойства случайного процесса полностью определяются значением его ординаты в заданный момент времени и не зависят от значений ординат процесса в предыдущие моменты времени, то такой случайный процесс называется Марковским. Иногда такие процессы называют процессами без последействия.

При исследовании вопросов зависимости или независимости двух или более сечений случайных процессов знание лишь математического ожидания и дисперсии с.п. не достаточно.

Для определения связи между различными случайными процессами используется понятие корреляционной функции – аналог понятия ковариации случайных величин (см. Т.8)

Корреляционной (ковариационной,

автоковариационной, автокорреляционной)

функцией случайного процесса называется

неслучайная функция

двух аргументов

называется

неслучайная функция

двух аргументов

равна

корреляционному моменту соответствующих

сечений

равна

корреляционному моменту соответствующих

сечений и

и :

:

или (с

учётом обозначения центрированной

случайной функции

)

имеем

)

имеем

Приведём

основные свойства корреляционной

функции

случайного

процесса

случайного

процесса .

.

1. Корреляционная функция при одинаковых

значениях аргументов равна дисперсии

с.п.

Действительно,

Доказанное свойство позволяет вычислить м.о. и корреляционную функцию являющимися основными характеристиками случайного процесса, необходимость в подсчёте дисперсии отпадает.

2. Корреляционная функция не меняется относительно замены аргументов, т.е. является симметрической функцией относительно своих аргументов: .

Это свойство непосредственно выводится из определения корреляционной функции.

3. Если к случайному процессу прибавить

неслучайную функцию, то корреляционная

функция не меняется, т.е. если

,

то.

Другими словами

,

то.

Другими словами

является периодической функцией относительно любой неслучайной функции.

Действительно, из цепочки рассуждений

следует, что . Отсюда получим требуемое свойство 3.

4. Модуль корреляционной функции не превосходит произведения с.к.о., т.е.

Доказательство свойства 4. проводится

аналогично как в пункте 12.2. (теорема

12..2), с учётом первого свойства

корреляционной функции с.п.

.

.

5. При умножении с.п. на

неслучайный множитель

на

неслучайный множитель её корреляционная функция умножится

на произведение

её корреляционная функция умножится

на произведение ,

т.е., если

,

т.е., если ,

то

,

то

5.1. Нормированная корреляционная функция

Наряду с корреляционной функцией с.п.

рассматривается также нормированная

корреляционная функция

(или

автокорреляционная

функция

) определяемая

равенством

определяемая

равенством

.

.

Следствие. На основании свойства 1 имеет место равенство

.

.

По своему смыслу

аналогичен коэффициенту корреляции

для с.в., но не является постоянной

величиной, а зависит от аргументов

аналогичен коэффициенту корреляции

для с.в., но не является постоянной

величиной, а зависит от аргументов и

и .

.

Перечислим свойства нормированной корреляционной функции :

1.

2.

3.

.

.

Пример 4.

Пусть с.п. определяется

формулой,

т.е. с.в.,

с.в.,

распределена

по нормальному закону с

Найти корреляционную и нормированную

функции случайного процесса

Решение. По определению имеем

т.е.

Отсюда с учётом определения нормированной

корреляционной функции и результатов

решения предыдущих примеров получим

Отсюда с учётом определения нормированной

корреляционной функции и результатов

решения предыдущих примеров получим =1,

т.е.

=1,

т.е. .

.

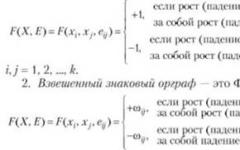

5.2. Взаимная корреляционная функция случайного процесса

Для определения степени зависимости сечений двух случайных процессов используют корреляционную функцию связи или взаимную корреляционную функцию.

Взаимной корреляционной функцией двух

случайных процессов

и

и называется неслучайная функция

называется неслучайная функция двух независимых аргументов

двух независимых аргументов и

и ,

которая при каждой паре значений

,

которая при каждой паре значений и

и равна корреляционному моменту двух

сечений

равна корреляционному моменту двух

сечений и

и

Два с.п.

и

и называютсянекоррелированными,

если

их взаимная корреляционная функция

тождественно равна нулю, т.е. если для

любых

называютсянекоррелированными,

если

их взаимная корреляционная функция

тождественно равна нулю, т.е. если для

любых и

и имеет место

имеет место Если же для любых

Если же для любых и

и окажется

окажется ,

то случайные процессы

,

то случайные процессы и

и называютсякоррелированными

(илисвязанными

).

называютсякоррелированными

(илисвязанными

).

Рассмотрим свойства взаимной корреляционной функции, которые непосредственно выводятся из её определения и свойств корреляционного момента (см. 12.2):

1.При одновременной перестановке индексов и аргументов взаимная корреляционная функция не меняется, то есть

2. Модуль взаимной корреляционной функции двух случайных процессов не превышает произведения их средних квадратичных отклонений, то есть

3. Корреляционная функция не изменится,

если к случайным процессам и

и прибавить неслучайные функции

прибавить неслучайные функции и

и соответственно, то есть

соответственно, то есть ,

где соответственно

,

где соответственно и

и

4. Неслучайные множители

можно

вынести за знак корреляции, то есть,

если

можно

вынести за знак корреляции, то есть,

если и, то

и, то

5. Если

,

то.

,

то.

6. Если случайные процессы

и

и некоррелированные

, то корреляционная

функция их суммы равна сумме их

корреляционных функций, то есть.

некоррелированные

, то корреляционная

функция их суммы равна сумме их

корреляционных функций, то есть.

Для оценки степени зависимости сечений

двух с.п. используют также нормированную

взаимную корреляционную функцию

,

определяемую равенством:

,

определяемую равенством:

Функция

обладает теми же свойствами, что и

функция

обладает теми же свойствами, что и

функция

,

но свойство 2

,

но свойство 2

заменяется

на следующее двойное неравенство

,

т.е. модуль нормированной взаимной

корреляционной функции не превышает

единицы.

,

т.е. модуль нормированной взаимной

корреляционной функции не превышает

единицы.

Пример 5.

Найти взаимную корреляционную

функцию двух с.п. и

и ,

где

,

где случайная

величина, при этом

случайная

величина, при этом

Решение. Так как,.

Погрешности измерений, обусловленные наведенными помехами и собственными шумами электронных приборов, описываются с помощью математической теории, получившей название "теория случайных процессов ". Напомним основные понятия этой теории, которые мы будем использовать в дальнейшем изложении и которые используются ГОСТ 8.009 [ГОСТ ] при нормировании случайной составляющей погрешности измерений.

, ,

|

|

.

.

используется , .

Аналогично, энергия измеряется не в

используется , .

Аналогично, энергия измеряется не в  , а в

, а в  ;

;

,

,

.

.

.

.

.

.