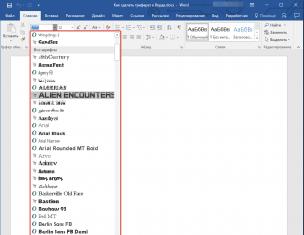

6.2. Закон распределения функции двух случайных величин.

Изложим общий метод решения задачи для наиболее простого случая функции двух аргументов.

Имеется система двух непрерывных случайных величин (X , Y ) с плотностью распределения f (x , y ) . Случайная величина Z связана с X и Y функциональной зависимостью:

Требуется найти закон распределения величины Z.

Для

решения задачи воспользуемся

геометрической интерпретацией. Функия

изобразится уже не кривой, а поверхностью

(рис. 6.2.1).

изобразится уже не кривой, а поверхностью

(рис. 6.2.1).

Найдем функцию распределения величины Z:

Проведем

плоскость Q,

параллельную плоскости хОу

,

на расстоянии z

от нее. Эта плоскость пересечет поверхность

по некоторой кривойК

.

Спроектируем кривую К

на плоскость хОу

.

Эта проекция, уравнение которой

по некоторой кривойК

.

Спроектируем кривую К

на плоскость хОу

.

Эта проекция, уравнение которой

,

разделит плоскостьхОу

на две области; для одной из них высота

поверхности над плоскостью хОу

будет меньше, а для другой - больше z

.

Обозначим D

ту область, для которой эта высота меньше

z

.

Чтобы выполнялось неравенство (6.2.1),

случайная точка (X

,

Y

)

очевидно,

должна попасть в область D

;

следовательно,

,

разделит плоскостьхОу

на две области; для одной из них высота

поверхности над плоскостью хОу

будет меньше, а для другой - больше z

.

Обозначим D

ту область, для которой эта высота меньше

z

.

Чтобы выполнялось неравенство (6.2.1),

случайная точка (X

,

Y

)

очевидно,

должна попасть в область D

;

следовательно,

Зная

конкретный вид функции

,

можно выразить пределы интегрирования

черезz

и написать выражение g

(z

)

в явном виде.

,

можно выразить пределы интегрирования

черезz

и написать выражение g

(z

)

в явном виде.

6.3. Закон распределения суммы двух случайных величин. Композиция законов распределения.

Воспользуемся

изложенным выше общим методом для

решения одной задачи, а именно для

нахождения закона распределения суммы

двух случайных величин. Имеется система

двух случайных величин (X

,

Y

)

с плотностью распределения f

(x

,у)

.

Рассмотрим сумму случайных величин X

и Y

:

и

найдем закон распределения величины

Z

.

Для этого построим на плоскости хОу

линию, уравнение которой

и

найдем закон распределения величины

Z

.

Для этого построим на плоскости хОу

линию, уравнение которой

(рис.

6.3.1). Это - прямая, отсекающая на осях

отрезки, равныеz

.

Прямая

(рис.

6.3.1). Это - прямая, отсекающая на осях

отрезки, равныеz

.

Прямая

делит плоскость хОу на две части; правее

и выше ее

делит плоскость хОу на две части; правее

и выше ее ;

левее и ниже

;

левее и ниже

Область D в данном случае - левая нижняя часть плоскости хОу , заштрихованная на рис. 6.3.1. Согласно формуле (6.3.2) имеем:

Это - общая формула для плотности распределения суммы двух случайных величин.

Из соображений симметричности задачи относительно X и Y можно написать другой вариант той же формулы:

Требуется

произвести композицию этих законов, т.

е. найти закон распределения величины:

.

.

Применим общую формулу для композиции законов распределения:

Подставляя эти выражения в уже встречавшуюся нам формулу

а это есть не что иное, как нормальный закон с центром рассеивания

К тому же выводу можно прийти значительно проще с помощью следующих качественных рассуждений.

Не раскрывая скобок и не производя преобразований в подынтегральной функции (6.3.3), сразу приходим к выводу, что показатель степени есть квадратный трехчлен относительно х вида

где в

коэффициент А

величина z

не входит совсем, в коэффициент В

входит в первой степени, а в коэффициент

С

- в квадрате. Имея это в виду и применяя

формулу(6.3.4), приходим к заключению, что

g

(z

)

есть показательная функция, показатель

степени которой - квадратный трехчлен

относительно z

,

а плотность аспределения; такого вида

соответствует нормальному закону.

Таким образом, мы; приходим к чисто

качественному выводу: закон распределения

величины z

должен быть нормальным. Чтобы найти

параметры этого закона -

и

и - воспользуемся теоремой сложения

математических ожиданий и теоремой

сложения дисперсий. По теореме сложения

математических ожиданий

- воспользуемся теоремой сложения

математических ожиданий и теоремой

сложения дисперсий. По теореме сложения

математических ожиданий

.

По теореме сложения дисперсий

.

По теореме сложения дисперсий

или

или

откуда

следует формула (6.3.7).

откуда

следует формула (6.3.7).

Переходя

от среднеквадратических отклонений к

пропорциональным им вероятным отклонениям,

получим:

.

.

Таким образом, мы пришли к следующему правилу: при композиции нормальных законов получается снова нормальный закон, причем математические ожидания и дисперсии (или квадраты вероятных отклонений) суммируются.

Правило композиции нормальных законов может быть обобщено на случай произвольного числа независимых случайных величин.

Если

имеется n

независимых случайных величин:

подчиненных нормальным законам с

центрами рассеивания

подчиненных нормальным законам с

центрами рассеивания

и среднеквадратическими отклонениями

и среднеквадратическими отклонениями

,то

величина

,то

величина

также подчинена нормальному закону с

параметрами

также подчинена нормальному закону с

параметрами

Если

система случайных величин (X

,

Y

)

распределена по нормальному закону, но

величины X

,

Y

зависимы, то нетрудно доказать, так же

как раньше, исходя из общей формулы

(6.3.1), что закон распределения величины

есть

тоже нормальный закон. Центры рассеивания

по-прежнему складываются алгебраически,

но для среднеквадратических отклонений

правило становится более сложным:

,

где, r

- коэффициент корреляции величин X

и Y

.

есть

тоже нормальный закон. Центры рассеивания

по-прежнему складываются алгебраически,

но для среднеквадратических отклонений

правило становится более сложным:

,

где, r

- коэффициент корреляции величин X

и Y

.

При сложении нескольких зависимых случайных величин, подчиненных в своей совокупности нормальному закону, закон распределения суммы также оказывается нормальным с параметрами

где

- коэффициент корреляции величинX

i

,

X

j

,

а суммирование распространяется на все

различные попарные комбинации величин

- коэффициент корреляции величинX

i

,

X

j

,

а суммирование распространяется на все

различные попарные комбинации величин

.

.

Мы убедились в весьма важном свойстве нормального закона: при композиции нормальных законов получается снова нормальный закон. Это - так называемое «свойство устойчивости». Закон распределения называется устойчивым, если при композиции двух законов этого типа получается снова закон того же типа. Выше мы показали, что нормальный закон является устойчивым. Свойством устойчивости обладают весьма немногие законы распределения. Закон равномерной плотности неустойчив: при композиции двух законов равномерной плотности на участках от 0 до 1 мы получили закон Симпсона.

Устойчивость нормального закона - одно из существенных условий его широкого распространения на практике. Однако свойством устойчивости, кроме нормального, обладают и некоторые другие законы распределения. Особенностью нормального закона является то, что при композиции достаточно большого числа практически произвольных законов распределения суммарный закон оказывается сколь угодно близок к нормальному вне зависимости от того, каковы были законы распределения слагаемых. Это можно проиллюстрировать, например, составляя композицию трех законов равномерной плотности на участках от 0 до 1. Получающийся при этом закон распределения g (z ) изображен на рис. 6.3.1. Как видно из чертежа, график функции g (z ) весьма напоминает график нормального закона.

Пусть пространство элементарных исходов случайного эксперимента таково, что каждому исходу i j ставиться в соответствие значение случайной величины, равное x i и значение случайной величины, равное y j .

- 1. Представим себе большую совокупность деталей, имеющих вид стержня. Эксперимент заключается в случайном выборе одного стержня. Этот стержень имеет длину, которую будем обозначать и толщину- (можно указать другие параметры-объем, вес, чистота обработки, выраженная в стандартных единицах).

- 2. Если рассмотреть акции двух различных корпораций, то в данный день биржевых торгов они каждая из них характеризуется определённой доходностью. Случайные величины и - это доходности акций этих корпораций.

В этих случаях мы можем говорить о совместном распределении случайных величин и или о "двумерной" случайной величине.

Если и дискретны и принимают конечное число значений (- n значений, а - k значений), то закон совместного распределения случайных величин и можно задать, если каждой паре чисел x i , y j (где x i принадлежит множеству значений, а y j -множеству значений) поставить в соответствие вероятность p i j , равную вероятности события, объединяющего все исходы i j (и состоящего лишь из этих исходов), которые приводят к значениям = xi ; = y j .

Такой закон распределения можно задать в виде таблицы:

Очевидно:

Если просуммировать все р i j в i -й строке, то получим:

Вероятность того, что случайная величина примет значение x i . Аналогично, если просуммировать все р i j в j -м столбце, то получим:

вероятность того, что принимает значение y j .

Соответствие x i P i (i = 1,2,n ) определяет закон распределения, также как соответствие y j P j (j = 1,2,k ) определяет закон распределения случайной величины.

Очевидно:

Раньше мы говорили, что случайные величины и независимы, если:

pij=PiP j (i= 1,2,,n ; j= 1,2,k).

Если это не выполняется, то и зависимы.

В чем проявляется зависимость случайных величин и и как ее выявить из таблицы?

Рассмотрим столбец y 1 . Каждому числу x i поставим в соответствие число:

p i/ 1 = (1)

которое будем называть условной вероятностью = x i при =y 1 . Обратите внимание на то, что это не вероятность P i события = x i , и сравните формулу (1) с уже известной формулой условной вероятности:

Соответствие x i р i / 1 , (i =1,2,n ) будем называть условным распределением случайной величины при =y 1 . Очевидно:

Аналогичные условные законы распределения случайной величины можно построить при всех остальных значениях, равных y 2 ; y 3 , y n , ставя в соответствие числу x i условную вероятность:

p i/j = ().

В таблице приведён условный закон распределения случайной величины при =y j

Можно ввести понятие условного математического ожидания при = y j

Заметим, что и равноценны. Можно ввести условное распределение при =x i соответствием

(j = 1,2,k ).

Также можно ввести понятие условного математического ожидания случайной величины при =x i :

Из определения следует, что если и независимы, то все условные законы распределения одинаковы и совпадают с законом распределения (напоминаем, что закон распределения определяется в таблице (*) первым и последним столбцом). При этом очевидно, совпадают все условные математические ожидания М:

/ = y j ,

при j = 1,2,k , которые равны М.

Если условные законы распределения при различных значениях различны, то говорят, что между и имеет место статистическая зависимость.

Пример I. Пусть закон совместного распределения двух случайных величин и задан следующей таблицей. Здесь, как говорилось ранее, первый и последний столбцы определяют закон распределения случайной величины, а первая и последняя строки - закон распределения случайной величины.

Найдем законы распределений случайных величин:

Чтобы получить =2 и =0, нужно чтобы приняла значение 0, а приняла значение 2. Так как и независимы, то

Р(=2; =0)= Р(=0; =2)=Р(=0)Р(=2)=1/12.

Очевидно также Р(=3; =0)=0.

Построим полигоны условных распределений. Здесь зависимость от довольно близка к функциональной: значению =1 соответствует единственное =2, значению =2 соответствует единственное =3, но при =0 мы можем говорить лишь, что с вероятностью 3/4 принимает значение 1 и с вероятностью 1/4 - значение 2.

Пример III. Рассмотрим закон совместного распределения и, заданный таблицей

Законы условных распределений не отличаются друг от друга при =1,2,3 и совпадают с законом распределения случайной величины. В данном случае и независимы.

Характеристикой зависимости между случайными величинами и служит математическое ожидание произведения отклонений и от их центров распределений (так иногда называют математическое ожидание случайной величины), которое называется коэффициентом ковариации или просто ковариацией.

cov(;) = M ((- M )(- M ))

Пусть = x 1 , x 2 , x 3 , x n , = y 1 , y 2 , y 3 ,y k .

Эту формулу можно интерпретировать так. Если при больших значениях более вероятны большие значения, а при малых значениях более вероятны малые значения, то в правой части формулы (2) положительные слагаемые доминируют, и ковариация принимает положительные значения.

Если же более вероятны произведения (x i - M )(y j - M ), состоящие из сомножителей разного знака, то есть исходы случайного эксперимента, приводящие к большим значениям в основном приводят к малым значениям и наоборот, то ковариация принимает большие по модулю отрицательные значения.

В первом случае принято говорить о прямой связи: с ростом случайная величина имеет тенденцию к возрастанию.

Во втором случае говорят об обратной связи: с ростом случайная величина имеет тенденцию к уменьшению или падению. Если примерно одинаковый вклад в сумму дают и положительные и отрицательные произведения (x i - M )(y j - M )p i j , то можно сказать, что в сумме они будут "гасить" друг друга и ковариация будет близка к нулю. В этом случае не просматривается зависимость одной случайной величины от другой.

Легко показать, что если:

P ((= x i )(= y j )) = P (= x i )P (= y j ) (i = 1,2,n ; j = 1,2,k ),

Действительно из (2) следует:

Здесь использовано очень важное свойство математического ожидания: математическое ожидание отклонения случайной величины от ее математического ожидания равно нулю .

Доказательство (для дискретных случайных величин с конечным числом значений).

Ковариацию удобно представлять в виде

cov(;)=M (- M - M +MM )=M ()- M (M )- M (M )+M (MM )= M ()- MM - MM +MM =M ()- MM

Ковариация двух случайных величин равна математическому ожиданию их произведения минус произведение математических ожиданий.

Легко доказывается следующее свойство математического ожидания: если и -независимые случайные величины, то:

М ()=ММ .

(Доказать самим, используя формулу:

Таким образом, для независимых случайных величин и cov(;)=0.

- 1. Монету подбрасывают 5 раз. Случайная величина - число выпавших гербов, случайная величина - число выпавших гербов в последних двух бросках. Построить совместный закон распределения случайных величин, построить условные законы распределения при различных значениях. Найти условные математические ожидания и ковариацию и.

- 2. Две карты наудачу извлекаются из колоды в 32 листа. Случайная величина - число тузов в выборке, случайная величина - число королей в выборке. Построить совместный закон распределения и, построить условные законы распределения при различных значениях. Найти условные математические ожидания и ковариацию и.

СИСТЕМЫ СЛУЧАЙНЫХ ВЕЛИЧИН

ЗАКОН РАСПРЕДЕЛЕНИЯ СИСТЕМЫ ДВУХ СЛУЧАЙНЫХ ВЕЛИЧИН

ЦЕЛЬ ЛЕКЦИИ: ввести понятие системы случайных величин и закона распределения систем двух случайных величин; определить условия зависимости и независимости случайных величин, сформулировать условный закон распределения и правило умножения плотностей.

Понятие о системе случайных величин

При теоретико-множественной трактовке любая случайная величинаX есть функция элементарного события, входящего в пространство эле-

значений случайной величины X .

Теперь перейдем к рассмотрению системы случайных величин – двух и более, например координаты падения снаряда X иY , набор оценокX 1 , X 2 , X n , выставленных в приложении к диплому.

Будем обозначать систему нескольких случайных величин X , Y , W как(X , Y , W ) . Эта система есть функция элементарного события

(X ,Y ,W )().

Таким образом, каждому элементарному событию ставится в соответствие несколько действительных чисел – значения, принятые случайными величинамиX , Y , W в результате опыта.

Пример . Пространство элементарных событий состоит из 28 элементов – 28 костей домино: { 00, 01, 1 1, 1 2, 56, 66} . Если слу-

чайная величина X – сумма очков, аY – их произведение, то совокупность значений этих случайных величин есть функция элементарного со-

бытия: так, при выпадении кости 34x 7 , y 12 .

Случайные величины, входящие в систему, могут быть как дискретными, так и непрерывными. Систему двух непрерывных случайных величин (X , Y ) можно изобразить случайной точкой на плоскости с коорди-

натами X иY (см. рис. 5.1). Систему трех случайных величин(X , Y , Z )

– случайной точкой в 3-мерном пространстве с координатамиX , Y , Z . И то и другое можно изобразить в виде вектора (см. рис. 5.2). Использование геометрической интерпретации удобно для системыn случайных величин(X 1 , X 2 , X n ) как вектора вn -мерном пространстве

X (X 1 ,X 2 ,X n ).

Свойства системы случайных величин определяются как свойствами отдельных величин, входящих в систему, так и зависимостями между случайными величинами.

Полной характеристикой системы случайных величин является закон распределения, который может быть представлен в виде функции распределения, плотности распределения, таблицы вероятностей отдельных значений случайного вектора и т. д.

(X ,Y ) |

||

(X ,Y ) |

||

Функция распределения системы двух случайных величин

Функцией распределения системы двух случайных величин(X , Y )

называется вероятность совместного выполнения двух неравенств –

X x и Y y

F (x, y) P{ X x, Y y} . | |

Событие в фигурных скобках означает произведение событий { X | x }и |

{ Y y} : | |

{ X x, Y y} { X x}{ Y y} . | |

Геометрическое истолкование функции распределения F (x , y ) |

вероятность попадания случайной точки (X , Y ) в бесконечный квадрант с вершиной в точке(X , Y ) , лежащей левее и ниже этой точки (см. рис. 5.3). Правая и верхняя границы в квадрант не включаются.

Из приведенной геометрической интер- | |||

претации можно вывести основные свойства | |||

функции распределения системы | двух слу- | (X ,Y ) |

|

чайных величин: | |||

1. Функция распределения F (x , y ) | есть неубы- | ||

вающая функция обоих своих аргументов, т. е.

x 1 ,F (x 2 ,y )F (x 1 ,y ); | |||||

y 1 ,F (x ,y 2 )F (x ,y 1 ). | Рис. 5.3. Геометрическая | ||||

На рис. 5.3 видно, что при увеличении x или | интерпретация F (x ,y ) | ||||

y заштрихованная область возрастает.

2. Если x илиy обращаются в, то функция распределения равна нулю:

F (x ,)F (,y )F (,)0 .

3. Если оба аргумента равны , то функция распределения равна единице:

F (,)1.

В этом случае квадрант заполняет всю плоскость, и попадание в него случайной точки есть достоверное событие.

4. Если один из аргументов обращается в | то функция распределения |

||||||||||

F (x , y ) становится равной функции распределения случайной величины, |

|||||||||||

соответствующей другому аргументу: | |||||||||||

F (x ,) | F 1 (x ),F ( | F 2 (y ), | |||||||||

где F 1 (x ) | x } – функция распределения случайной величиныX ; |

||||||||||

F 2 (y )P {Y | y } – функция распределения случайной величиныY . |

||||||||||

В этом случае квадрант превращается в полуплоскость, вероятность попа- |

|||||||||||

дания в которую есть функция распределения случайной величины, соот- |

|||||||||||

ветствующей другому аргументу (см. рис. 5.4–5.5). | |||||||||||

Рис. 5.4. Функция распреде- | Рис. 5.5. Функция распределения |

||||||||||

ления F 1 (x ) | F2 (у) |

||||||||||

Из определения функции распределения | F (x , y ) следует, что она |

||||||||||

непрерывна слева по любому аргументу. При геометрической интерпрета- |

|||||||||||

ции функции | F (x ,y ) | – это некоторая поверхность, обладающая указан- |

|||||||||

ными свойствами, | а вид этой поверхности |

||||||||||

зависит от того, будут ли входящие в систему |

|||||||||||

случайные величины дискретными или непре- |

|||||||||||

Знание функции распределения F (x , y ) |

|||||||||||

позволяет решить задачу о вычислении веро- |

|||||||||||

ятности попадания случайной точки (X , Y ) в |

|||||||||||

прямоугольник R (см. рис. 5.6). Решение ока- |

|||||||||||

Рис. 5.6. Вероятность попа- |

|||||||||||

зывается | достаточно простым, если учесть |

||||||||||

дания в область R | |||||||||||

определение (5.1) функции F (x , y ) : |

|||||||||||

P{(X, Y) | R }F (,)F (,)F (,) | F (,). |

|||||||||

Вычисление сводится к вычитанию из большого квадранта двух других и |

|||||||||||

добавке дважды вычтенного квадранта с вершиной в точке (,) . |

|||||||||||

Функции распределения F (x , y ) – наиболее универсальная форма

закона распределения, пригодная как для дискретных, так и непрерывных случайных величин.

Система двух дискретных случайных величин. Матрица распределения

Пусть множества возможных значений системы случайных величин (X , Y ) конечны, т. е.

X :{x 1 ,x 2 ,x n },Y :{y 1 ,y 2 ,y m }.

Обозначим через

xi , Y | y j } , | |||

где событие | xi , Y | y j } есть произведение событий{ X | x i} и |

p ij (i 1 ,n ;j 1 ,m ).

p 1j | |||||||||

(X ,Y ) : | p 2j | p2 m | |||||||

Сумма всех вероятностей матрицы распределения равна единице:

p ij1.

i 1 j1

При наличии матрицы распределения системы двух дискретных случайных величин (X , Y ) ее функция распределения находится суммирова-

Если множества возможных значений дискретных случайных величин X иY бесконечные, но счетные, то тогда матрица распределения имеет бесконечные размеры, но ее свойства остаются теми же, что и при конечныхn иm .

По матрице распределения системы (X , Y ) можно найти законы (ряды) распределения отдельных случайных величинX иY . Для это обо-

Px i | P{ X xi }; Py j P{ Y yj } . |

Событие { X | x i } представим как сумму несовместных вариантов: |

{ X xi } { X xi ; Y y1 } { X xi ; Y y2 } { X xi ; Y ym } .

Просуммировав соответствующие вероятности, получаем

Px i | P{ X xi } | p ij; |

P yj | P{ Y yj } | p ij. |

Таким образом, чтобы найти вероятность того, что отдельная случайная величина, входящая в систему, примет определенное значение, надо

просуммировать вероятности p ij , стоящие в соответствующей этому зна-

чению строке (столбце) матрицы распределения.

Система двух непрерывных случайных величин. Совместная плотность распределения

Система двух случайных величин (X , Y ) называется непрерывной, если ее функция распределенияF (x , y ) есть непрерывная функция, дифференцируемая по каждому из аргументов, и у которой существует вторая

должны быть непрерывными случайными величинами.

Для определения плотности распределения рассмотрим на плоскости

P {(X ,Y ) | RXY } F(x x, y y) F(x, y y) |

||||

x ,y )F (x ,y ). | |||||

При переходе к пределу получаем | |||||

x, y y) F(x, y | y )F (x x ,y )F (x ,y ) | ||||

Так как условились, каждому из аргументов,

Рис. 5.7. Вероятность попадания в областьR XY

что F (x , y ) непрерывна и дифференцируема по

то последнее выражение есть не что иное, как вторая смешанная производная функции распределения

f (x, y) | x y F (x ,y ), |

x которая является совместной плотностью распределения f (x , y ) системы двух непрерывных случайных величин(X , Y ) .

Геометрически совместная плотность f (x , y ) изображается поверхностью распределения (см. рис. 5.8).

f (x , y )

Свойства плотности распределения :

1. Совместная плотность распределения, положительно определенная функция по обоим аргументам,

f (x ,y )0 .

2. Двойной интеграл в бесконечных пределах от плотности распределения равен единице (условие нормировки):

f (x, y) dxdy1 , |

т. е. объем под поверхностью распределения равен единице. Вводится понятие элемента

вероятности для системы двух непрерывных случайных величин в виде

f (x, y) dxdy, | |||

который равен вероятности по- | |||

падания случайной точки (X , Y ) | |||

на элементарный прямоугольник | |||

dxdy . Приближенно эта вероят- | |||

ность равна объему элементар- | |||

ного параллелепипеда с высотой | Рис. 5.8. Поверхность распределения |

||

f (x , y ) , опирающегося на пря- | |||

моугольник dxdy .

Вероятность попадания случайной точки (X , Y ) в некоторую область(D ) будет равна

P{(X, Y) | f (x, y) dxdy. |

Положив в выражении (5.6) x y , докажем второе свойство (см. выражение (5.4)) совместной плотности распределения, т. е.

f (x, y) dxdy F(,) 1 .

Выразим законы распределения отдельных случайных величин, входящих в систему, через закон распределения системы двух случайных величин (X , Y ) .

Для того чтобы получить функцию распределения одной из случайных величин, входящих в систему, нужно положить в выражении (5.6) аргумент, соответствующий другой случайной величине, равным , т. е.

F1 (x) | f (x, y) dxdy, | |

F 2 (y ) | f (x, y) dxdy. |

Продифференцировав выражения (5.7) и (5.8) по соответствующим переменным, получим

dF1 (x) | f (x, y) dy, | ||||||

f (x, y) dx. | |||||||

Таким образом, чтобы получить плотность распределения одной из величин, входящих в систему, нужно проинтегрировать совместную плотность распределения в бесконечных пределах по другой случайной величине.

Зависимые и независимые случайные величины. Условные законы распределения

Решение обратной задачи – отыскание закона распределения системы по законам распределения входящих в систему случайных величин – в общем случае невозможно.

В частном случае, когда случайные величины независимы, задача

и { Y y 1 } и т. д.

Зависимость и независимость всегда взаимны. Таким образом, две случайные величины называются независимыми , если закон распределения каждой из них не зависит от того, какое значение приняла другая ве-

Для зависимых случайных величин вводится понятие условного закона распределения .

Условным законом распределения случайной величины X , входящей в систему(X , Y ) , называется ее закон распределения, вычисленный

при условии, что другая случайная величина приняла определенное значение. Условный закон распределения можно задавать или как условную функцию распределения F (x / y ) , или как условную плотностьf (x / y ) .

Для произвольного типа систем случайных величин (X , Y ) условная функция распределения может быть записана в виде

F (x, y) P{ X x, Y y} P{ X x} P{ Y y/ X x}

F1 (x) P{ Y y/ X x} .

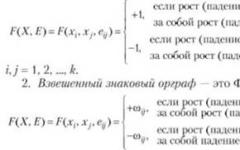

Функция двух случайных величин. Распределение суммы

независимых слагаемых.

Определение 10.2. Если каждой паре возможных значений случайных величин Х и Y соответ-ствует одно возможное значение случайной величины Z , то Z называют функцией двух случайных аргументов X и Y : Z = φ (X, Y ).

Рассмотрим в качестве такой функции сумму Х + Y . В некоторых случаях можно найти ее закон распределения, зная законы распределения слагаемых.

1) Если X и Y – дискретные независимые случайные величины, то для определения закона распределения Z = Х + Y нужно найти все возможные значения Z и соответствующие им вероятности.

Пример 4. Рассмотрим дискретные случайные величины X и Y , законы распределения которых имеют вид: Х -2 1 3 Y 0 1 2

р 0,3 0,4 0,3 р 0,2 0,5 0,3

Найдем возможные значения Z

: -2 + 0 = -2 (р

= 0,3·0,2 = 0,06), -2 + 1 = -1 (р

= 0,3·0,5 = 0,15), -2 + 2 = 0 (р

= 0,3·0,3 = 0,09), 1 + 0 = 1 (р

= 0,4·0,2 = 0,08), 1 + 1 = 2 (р

= 0,4·0,5 = 0,2), 1 + 2 = 3 (р =

0,4·0,3 = 0,12), 3 + 0 = 3 (р

= 0,3·0,2 = 0,06), 3 + 1 = 4 (р

= 0,3·0,5 = 0,15), 3 + 2 = 5 (р

= 0,3·0,3 = 0,09). Сложив вероятности повторившегося дважды значения Z =

3, составим ряд распределения для Z

:

| Z | -2 | -1 | 0 | 1 | 2 | 3 | 4 | 5 |

| р | 0,06 | 0,15 | 0,09 | 0,08 | 0,2 | 0,18 | 0,15 | 0,09 |

Если X и Y – непрерывные независимые случайные величины, то, если плотность вероятно-сти хотя бы одного из аргументов задана на (-∞, ∞) одной формулой, то плотность суммы g (z ) можно найти по формулам

Где f 1 (x ), f 2 (y ) – плотности распределения слагаемых. Если возможные значения аргументов неотрицательны, то

Замечание. Плотность распределения суммы двух независимых случайных величин называют композицией .

Устойчивость нормального распределения.

Определение 10.3. Закон распределения вероятностей называется устойчивым , если компози-ция таких законов есть тот же закон (возможно, отличающийся другими значениями парамет-ров).

В частности, свойством устойчивости обладает нормальный закон распределения: композиция нормальных законов тоже имеет нормальное распределение, причем ее математическое ожидание и дисперсия равны суммам соответствующих характеристик слагаемых.

Лекция 11.

Нормальный закон распределения на плоскости. Линейная регрессия. Линейная корреляция.

Определение 11.1. Нормальным законом распределения на плоскости называют распре-деление вероятностей двумерной случайной величины (X, Y ), если

(11.1)

(11.1)

Таким образом, нормальный закон на плоскости определяется 5 параметрами: а 1 , а 2 , σ х , σ у , r xy , где а 1 , а 2 – математические ожидания, σ х , σ у – средние квадратические отклонения, r xy – коэффи-циент корреляции Х и Y . Предположим, что r xy = 0, то есть Х и Y некоррелированы. Тогда из (11.1) получим:

Следовательно, из некоррелированности составляющих нормально распределенной двумерной случайной величины следует их независимость, то есть для них понятия независимости и некоррелированности равносильны.

Линейная регрессия.

Пусть составляющие Х и Y двумерной случайной величины (Х , Y ) зависимы. Будем считать, что одну из них можно приближенно представить как линейную функцию другой, например

Y ≈ g (Х ) = α + βХ, (11.2)

И определим параметры α и β с помощью метода наименьших квадратов.

Определение 11.2. Функция g (Х ) = α + βХ называется наилучшим приближением Y в смысле метода наименьших квадратов, если математическое ожидание М (Y - g (Х )) 2 принимает наименьшее возможное значение; функцию g (Х ) называют среднеквадратической регрессией Y на Х .

Теорема 11.1. Линейная средняя квадратическая регрессия Y на Х имеет вид:

(11.3)

(11.3)

Где - коэффициент корреляции Х и Y.

Доказательство. Рассмотрим функцию

F (α, β ) = M (Y – α – βX )² (11.4)

И преобразуем ее, учитывая соот-ношения M (X – m x ) = M (Y – m y ) = 0, M ((X – m x )(Y – m y )) = =K xy = rσ x σ y :

Найдем стационарные точки полученной функции, решив систему

Решением системы будет

Решением системы будет  .

.

Можно проверить, что при этих значениях функция F (α, β ) имеет минимум, что доказывает утверждение теоремы.

Определение 11.3.

Коэффициент  называется коэффициентом регрессии

Y

на

Х

, а прямая

называется коэффициентом регрессии

Y

на

Х

, а прямая  - (11.5)

- (11.5)

- прямой среднеквадратической регрессии Y на Х .

Подставив координаты стационарной точки в равенство (11.4), можно найти минимальное значение функции F

(α, β

), равное  Эта величина называется остаточной дисперсией

Y

относительно Х

и характеризует величину ошибки, допускаемой при замене Y

на g

(Х

) = α+βХ.

При

Эта величина называется остаточной дисперсией

Y

относительно Х

и характеризует величину ошибки, допускаемой при замене Y

на g

(Х

) = α+βХ.

При  остаточная дисперсия равна 0, то есть равенство (11.2) является не приближенным, а точным. Следовательно, при Y

и Х

связаны линейной

функциональной зависимостью. Аналогично можно получить прямую среднеквадратической регрессии Х

на Y

:

остаточная дисперсия равна 0, то есть равенство (11.2) является не приближенным, а точным. Следовательно, при Y

и Х

связаны линейной

функциональной зависимостью. Аналогично можно получить прямую среднеквадратической регрессии Х

на Y

:

(11.6)

(11.6)

И остаточную дисперсию Х относительно Y . При обе прямые регрессии совпадают. Решив систему из уравнений (11.5) и (11.6), можно найти точку пересечения прямых регрессии – точку с координатами (т х , т у ), называемую центром совместного распределения величин Х и Y .

Линейная корреляция.

Для двумерной случайной величины (Х, Y ) можно ввести так называемое условное математи-ческое ожидание Y при Х = х . Для дискретной случайной величины оно определяется как

(11.7)

(11.7)

Для непрерывной случайной величины –

. (11.8)

. (11.8)

Определение 11.4. Функцией регрессии Y на Х называется условное математическое ожидание

M (Y / x ) = f (x ).

Аналогично определяется условное математическое ожидание Х и функция регрессии Х на Y.

Определение 11.5. Если обе функции регрессии Х на Y и Y на Х линейны, то говорят, что Х и Y связаны линейной корреляционной зависимостью .

При этом графики линейных функций регрессии являются прямыми линиями, причем можно доказать, что эти линии совпадают с прямыми среднеквадратической регрессии.

Теорема 11.2. Если двумерная случайная величина (Х, Y ) распределена нормально, то Х и Y связаны линейной корреляционной зависимостью.

Доказательство. Найдем условный закон распределения Y

при Х = х  , используя формулу двумерной плотности вероятности нормального распределения (11.1) и формулу плотности вероятности Х

:

, используя формулу двумерной плотности вероятности нормального распределения (11.1) и формулу плотности вероятности Х

:

. (11.9)

. (11.9)

Сделаем замену  . Тогда

. Тогда

= . Полученное распределение является нормальным, а его мате-матическое ожидание

. Полученное распределение является нормальным, а его мате-матическое ожидание  есть функция регрессии Y

на Х

(см. опреде-ление 11.4)). Аналогично можно получить функцию регрессии Х

на Y

:

есть функция регрессии Y

на Х

(см. опреде-ление 11.4)). Аналогично можно получить функцию регрессии Х

на Y

:

.

.

Обе функции регрессии линейны, поэтому корреляция между Х и Y линейна, что и требовалось доказать. При этом уравнения прямых регрессии имеют вид

,

,  ,

,

То есть совпадают с уравнениями прямых среднеквадратической регрессии (см. формулы (11.5), (11.6)).

Лекция 12.

Распределения «хи-квадрат», Стьюдента и Фишера. Связь этих распределений с нормаль-ным распределением.

Рассмотрим некоторые распределения, связанные с нормальным и широко применяющиеся в математической статистике.

Распределение «хи-квадрат».

Пусть имеется несколько нормированных нормально распределенных случайных величин: Х 1 , Х 2 ,…, Х п (a i = 0, σ i = 1). Тогда сумма их квадратов

(12.1)

(12.1)

Является случайной величиной, распределенной по так называемому закону «хи-квадрат»

с k = n

степенями свободы; если же слагаемые связаны каким-либо соотношением (например,  ), то число степеней свободы k = n –

1.

), то число степеней свободы k = n –

1.

Плотность этого распределения

(12.2)

(12.2)

Здесь  - гамма-функция; в частности, Г(п +

1) = п

! .

- гамма-функция; в частности, Г(п +

1) = п

! .

Следовательно, распределение «хи-квадрат» определяется одним параметром – числом степе-ней свободы k .

Замечание 1. С увеличением числа степеней свободы распределение «хи-квадрат» постепенно приближается к нормальному.

Замечание 2.

С помощью распределения «хи-квадрат» определяются многие другие распреде-ления, встречающиеся на практике, например, распределение случайной величины  - длины случайного вектора (Х

1 , Х

2 ,…, Х

п

), координаты которого независимы и распределены по нормальному закону.

- длины случайного вектора (Х

1 , Х

2 ,…, Х

п

), координаты которого независимы и распределены по нормальному закону.

Распределение Стьюдента.

Рассмотрим две независимые случайные величины: Z, имеющую нормальное распределение и нормированную (то есть М (Z ) = 0, σ (Z ) = 1), и V , распределенную по закону «хи-квадрат» с k степенями свободы. Тогда величина

(12.3)

(12.3)

Имеет распределение, называемое t – распределением или распределением Стьюдента с k степенями свободы.

С возрастанием числа степеней свободы распределение Стьюдента быстро приближается к нормальному.

Распределение F Фишера – Снедекора.

Рассмотрим две независимые случайные величины U и V , распределенные по закону «хи-квадрат» со степенями свободы k 1 и k 2 и образуем из них новую величину

. (12.4)

. (12.4)

Ее распределение называют распределением F Фишера – Снедекора со степенями свободы k 1 и k 2 . Плотность его распределения имеет вид

(12.5)

(12.5)

Где  . Таким образом, распределение Фишера определяется двумя параметрами – числами степеней свободы.

. Таким образом, распределение Фишера определяется двумя параметрами – числами степеней свободы.

Определение . Случайные величины Х 1 , Х 2 , …, Х n называются независимыми, если для любых x 1, x 2 , …, x n независимы события

{ω: Х 1 (ω) < x},{ω: Х 2 (ω) < x},…, {ω: Х n (ω) < x n }.

Из определения непосредственно следует, что для независимых случайных величин Х 1 , Х 2 , …, Х n функция распределения n -мерной случайной величины Х = Х 1 , Х 2 , …, Х n равна произведению функций распределения случайных величин Х 1 , Х 2 , …, Х n

F (x 1 , x 2 , …, x n ) = F (x 1 )F (x 2 )…F (x n ). (1)

Продифференцируем равенство (1) n раз по x 1 , x 2 , …, x n , получим

p (x 1 , x 2 , …, x n ) = p (x 1 )p (x 2 )…p (x n ). (2)

Можно дать другое определение независимости случайных величин.

Если закон распределения одной случайной величины не зависит от того, какие возможные значения приняли другие случайные величины, то такие случайные величины называются независимыми в совокупности.

Например, приобретены два лотерейных билета различных выпусков. Пусть Х – размер выигрыша на первый билет, Y – размер выигрыша на второй билет. Случайные величины Х и Y – независимые, так как выигрыш одного билета никак не повлияет на закон распределения другого. Но если билеты одного выпуска, то Х и Y – зависимые.

Две случайные величины называются независимыми, если закон распределения одной из них не меняется от того, какие возможные значения приняла другая величина.

Теорема 1 (свёртки) или «теорема о плотности суммы 2 случайных величин».

Пусть X = (Х 1 ;Х 2 ) – независимая непрерывная двумерная случайная величина, Y = Х 1 + Х 2 . Тогда плотность распределения

Доказательство . Можно показать, что если , то

где Х = (Х 1 , Х 2 , …, Х n ). Тогда, если Х = (Х 1 , Х 2), то функцию распределения Y = X 1 + X 2 можно определить так (рис. 1) –

= .

.

В соответствии с определением, функция ![]() является плотностью распределения случайной величины Y = X 1 + X 2 , т.е.

является плотностью распределения случайной величины Y = X 1 + X 2 , т.е.

p y

(t

) = ![]() что и требовалось доказать.

что и требовалось доказать.

Выведем формулу для нахождения распределения вероятностей суммы двух независимых дискретных случайных величин.

Теорема 2. Пусть Х 1 , Х 2 – независимые дискретные случайные величины,

![]() ,

, ![]() , тогда

, тогда

Доказательство . Представим событие A x = {Х 1 +Х 2 = x } в виде суммы несовместимых событий

A x = å(Х 1 = x i ; Х 2 = x – x i).

Так как Х 1 , Х 2 – независимые то P (Х 1 = x i ; Х 2 = x – x i) = P (Х 1 = x i) P (Х 2 = x – x i), тогда

P (A x ) = P (å(Х 1 = x i ; Х 2 = x – x i )) = å(P (Х 1 = x i ) P (Х 2 = x – x i)),

что и требовалось доказать.

Пример 1. Пусть Х 1 , Х 2 – независимые случайные величины, имеющие нормальное распределение с параметрами N (0;1); Х 1 , Х 2 ~ N (0;1).

Найдём плотность распределения их суммы (обозначим Х 1 = x , Y = X 1 +X 2)

Легко видеть, что подинтегральная функция является плотностью распределения нормальной случайной величины с параметрами а = , , т.е. интеграл равен 1.

.

.

Функция p y (t ) является плотностью нормального распределения с параметрами а = 0, s = . Таким образом сумма независимых нормальных случайных величин с параметрами (0,1) имеет нормальное распределение с параметрами (0,), т.е. Y = Х 1 + Х 2 ~ N (0;).

Пример 2

. Пусть заданы две дискретные независимые случайные величины, имеющие распределение Пуассона ![]()

![]() , тогда

, тогда

![]() , (5)

, (5)

где k, m, n = 0, 1, 2, …,¥.

По теореме 2 имеем:

Пример 3.

Пусть Х

1, Х

2 – независимые случайные величины, имеющие экспоненциальное распределение  . Найдём плотность Y

= Х

1 +Х

2 .

. Найдём плотность Y

= Х

1 +Х

2 .

Обозначим x = x 1. Так как Х 1, Х 2 – независимые случайные величины, то воспользуемся «теоремой свертки»

Можно показать, что если задана сумма (Х i

имеют экспоненциальное распределение с параметром l), то Y

=имеет распределение ![]() , которое называется распределением Эрланга (n

– 1) порядка. Этот закон был получен при моделировании работы телефонных станций в первых работах по теории массового обслуживания.

, которое называется распределением Эрланга (n

– 1) порядка. Этот закон был получен при моделировании работы телефонных станций в первых работах по теории массового обслуживания.

В математической статистике часто используют законы распределения случайных величин, являющихся функциями независимых нормальных случайных величин. Рассмотрим три закона наиболее часто встречающихся при моделировании случайных явлений.

Теорема 3. Если независимы случайные величины Х 1, ..., Х n , то независимы также функции от этих случайных величин Y 1 = f 1 (Х 1), ...,Y n = f n (Х n ).

Распределение Пирсона (c 2 -распределение ). Пусть Х 1, ..., Х n – независимые нормальные случайные величины с параметрами а = 0, s = 1. Составим случайную величину