Корреляционные моменты, коэффициент корреляции - это числовые характеристики, тесно связанные во введенным выше понятием случайной величины, а точнее с системой случайных величин. Поэтому для введения и определения их значения и роли необходимо пояснить понятие системы случайных величин и некоторые свойства присущие им.

Два или более случайные величины, описывающих некоторое явление называют системой или комплексом случайных величин.

Систему нескольких случайных величин X, Y, Z, …, W принято обозначать через (X, Y, Z, …, W).

Например, точка на плоскости описывается не одной координатой, а двумя, а в пространстве - даже тремя.

Свойства системы нескольких случайных величин не исчерпываются свойствами отдельных случайных величин, входящих в систему, а включают также взаимные связи (зависимости) между случайными величинами. Поэтому при изучении системы случайных величин следует обращать внимание на характер и степень зависимости. Эта зависимость может быть более или менее ярко выраженной, более или менее тесной. А в других случаях случайные величины оказаться практически независимыми.

Случайная величина Y называется независимой от случайной величины Х, если закон распределения случайной величины Y не зависит от того какое значение приняла величина Х.

Следует отметить, что зависимость и независимость случайных величин есть всегда явление взаимное: если Y не зависит от Х, то и величина Х не зависит от Y. Учитывая это, можно привести следующее определение независимости случайных величин.

Случайные величины Х и Y называются независимыми, если закон распределения каждой из них не зависит от того, какое значение приняла другая. В противном случае величины Х и Y называются зависимыми.

Законом распределения случайной величины называется всякое соотношение, устанавливающее связь между возможными значениями случайной величины и соответствующими им вероятностями.

Понятие "зависимости" случайных величин, которым пользуются в теории вероятностей, несколько отличается от обычного понятия "зависимости" величин, которым пользуются в математике. Так, математик под "зависимостью" подразумевает только один тип зависимости - полную, жесткую, так называемую функциональную зависимость. Две величины Х и Y называются функционально зависимыми, если, зная значение одного из них, можно точно определить значение другой.

В теории вероятностей встречаются несколько с иным типом зависимости - вероятностной зависимостью. Если величина Y связана с величиной Х вероятностной зависимостью, то, зная значение Х, нельзя точно указать значение Y, а можно указать её закон распределения, зависящий от того, какое значение приняла величина Х.

Вероятностная зависимость может быть более или менее тесной; по мере увеличения тесноты вероятностной зависимости она все более приближается к функциональной. Т.о., функциональную зависимость можно рассматривать как крайний, предельный случай наиболее тесной вероятностной зависимости. Другой крайний случай - полная независимость случайных величин. Между этими двумя крайними случаями лежат все градации вероятностной зависимости - от самой сильной до самой слабой.

Вероятностная зависимость между случайными величинами часто встречается на практике. Если случайные величины Х и Y находятся в вероятностной зависимости, то это не означает, что с изменением величины Х величина Y изменяется вполне определенным образом; это лишь означает, что с изменением величины Х величина Y

имеет тенденцию также изменяться (возрастать или убывать при возрастании Х). Эта тенденция соблюдается лишь в общих чертах, а в каждом отдельном случае возможны отступления от неё.

Примеры вероятностной зависимости.

Выберем наугад одного больного с перитонитом. случайная величина Т - время от начала заболевания, случайная величина О - уровень гомеостатических нарушений. Между этими величинами имеется явная зависимость, так как величина Т является одной из наиболее главных причин, определяющих величину О.

В то же время между случайной величиной Т и случайной величиной М, отражающей летальность при данной патологии, имеется более слабая вероятностная зависимость, так как случайная величина хоть и влияет на случайную величину О, однако не является главной определяющей.

Тем более, если рассматривать величину Т и величину В (возраст хирурга), то данные величины практически независимы.

До сих пор мы обсуждали свойства систем случайных величин, давая только словесное разъяснение. Однако существуют числовые характеристики, посредством которых исследуются свойства как отдельных случайных величин, так и системы случайных величин.

Одной из важнейших характеристик случайной величины нормального распределения является математическое ожидание.

Рассмотрим дискретную случайную величину Х, имеющую возможные значения Х 1 , Х2 , ... , Хn с вероятностями р1 , р2 , ... , рn . нам требуется охарактеризовать каким-то числом положение значений случайной величины на оси абсцисс с учетом того, что эти значения имеют различные значения. Для этой цели обычно пользуются так называемым "средним взвешенным" из значений Хi , причем каждое значение Хi при осреднении должно учитываться с "весом", пропорциональным вероятности этого значения. Таким образом, если обозначить "среднее взвешенное" через М[X] или mx , получим

или, учитывая, что,

Математическим ожиданием случайной величины называется сумма произведений всех возможных значений случайной величины на вероятности этих значений.

Для большей наглядности рассмотрим одну механическую интерпретацию введенного понятия. Пусть на оси абсцисс расположены точки с абсциссами х 1 , х2 , …, хn , в которых сосредоточены соответственно массы р1 , р2 , … , рn , причем. Тогда математическое ожидание есть не что иное, как абсцисса центра тяжести данной системы материальных точек.

Формула (1) для математического ожидания соответствует случаю дискретной случайной величины. Для непрерывной величины Х математическое ожидание, естественно, выражается не суммой, а интегралом:

где - плотность распределения величины Х.

Формула (2) получается из формулы (1), если в ней заменить отдельные значения Хi непрерывно изменяющимся параметром Х, соответствующие вероятности рi элементом вероятности f(x)dx, конечную сумму - интегралом.

В механической интерпретации математическое ожидание непрерывной случайной величины сохраняет тот же смысл - абсциссы центра тяжести в случае, когда масса распределения по оси абсцисс непрерывна с плотностью f(x).

Следует отметить, что математическое ожидание существует не для всех случайных величин, что, однако, по мнению некоторых ученых, не представляет для практики существенного интереса.

Помимо математического ожидания важное значение имеют также другие числовые случайной величины - моменты.

Понятие момента широко применяется в механике для описания распределения масс (статистические моменты, моменты инерции и т.д.). Совершенно теми же приемами пользуются в теории вероятностей для описания основных свойств распределения случайной величины. Чаще всего применяются на практике моменты двух видов: начальные и центральные.

Начальным моментом s-го порядка прерывной случайной величины Х называется сумма вида

Очевидно это определение совпадает с определением начального момента порядка s в механике, если на оси абсцисс в точках х 1 , …, хn сосредоточена масса р1 , …, рn .

Для непрерывной случайной величины Х начальным моментом s-го порядка называется интеграл

Очевидно, что

т.е. начальный момент s-го порядка случайной величины Х есть не что иное, как математическое ожидание s-ой степени этой случайной величины.

Перед тем как дать определение центрального момента введем понятие "центрированной случайной величины".

Пусть имеется случайная величина Х с математическим ожиданием m x . Центрированной случайной величиной, соответствующей величине Х, называется отклонение случайной величины Х от её математического ожидания

Нетрудно видеть, что математическое ожидание центрированной случайной величины равно нулю.

Центрирование случайной величины равносильно переносу начала координат в точку, абсцисса которой равна математическому ожиданию.

Центральным моментом порядка s случайной величины Х называется математическое ожидание s-ой степени соответствующей центрированной случайной величины:

Для прерывной случайной величины s-й центральный момент выражается суммой

а для непрерывной - интегралом

Важнейшее значение имеет второй центральный момент, который называют дисперсией и обозначают D[X]. Для дисперсии имеем

Дисперсия случайной величины есть характеристика рассеивания, разбросанности значений случайной величины около её математического ожидания. Само слово "дисперсия" означает "рассеивание".

Механической интерпретацией дисперсии является не что иное, как момент инерции заданного распределения масс относительно центра тяжести.

На практике часто применяется также величина

называемая средним квадратичным отклонением (иначе - "стандартом") случайной величины Х.

Теперь перейдем к рассмотрению характеристик систем случайных величин.

Начальным моментом порядка k,s системы (Х, Y) называется математическое ожидание произведения X k и Y s ,

xk,s =M.

Центральным моментом порядка k,s системы (Х, Y) называется математическое ожидание произведения k-ой и s-ой степени соответствующих центрированных величин:

Для прерывных случайных величин

где р ij - вероятность того, что система (Х, Y) примем значения (xi , yj ), а сумма рассматривается по всем возможным значениям случайных величин X,Y.

Для непрерывных случайных величин

где f(x,y) - плотность распределения системы.

Помимо чисел k и s, характеризующих порядок момента по отношению к отдельным величинам, рассматривается ещё суммарный порядок момента k+s, равный сумме показателей степеней при Х и Y. Соответственно суммарному порядку моменты классифицируют на первый, второй и т.д. На практике обычно применяются только первые и вторые моменты.

Первые начальные моменты представляют собой математические ожидания величин Х и Y, входящих в систему

у1,0 =mx у0,1 =my.

Совокупность математических ожиданий m x , my представляет собой характеристику положения системы. Геометрически это координаты средней точки на плоскости, вокруг которой происходит рассеивание точки (Х, Y).

Важную роль на практике играют также вторые центральные моменты систем. Два из них представляют собой дисперсии величин Х и Y

характеризующие рассеивание случайной точки в направлении осей Ox и Oy.

Особую роль играет второй смещенный центральный момент:

называемый корреляционным моментом (иначе - "моментом связи")случайных величин Х и Y.

Корреляционный момент есть характеристика системы случайных величин, описывающая, помимо рассеивания величин Х и Y, еще и связь между ними. Для того, чтобы убедиться в этом отметим, что корреляционный момент независимых случайных величин равен нулю.

Заметим, что корреляционный момент характеризует не только зависимость величин, но и их рассеивание. Поэтому для характеристики связи между величинами (Х;Y) в чистом виде переходят от момента K xy к характеристике

где уx , уy - средние квадратичные отклонения величин Х и Y. Эта характеристика называется коэффициентом корреляции величин Х и Y.

Из формулы (3) видно, что для независимых случайных величин коэффициент корреляции равен нулю, так как для таких величин kxy =0.

Случайные величины, для которых rxy =0, называют некоррелированными (несвязанными).

Отметим однако, что из некоррелированности случайных величин не следует их независимость.

Коэффициент корреляции характеризует не всякую зависимость, а только так называемую линейную зависимость. Линейная вероятностная зависимость случайных величин заключается в том, что при возрастании одной случайной величины другая имеет тенденцию возрастать (или же убывать) по линейному закону. Т.о., коэффициент корреляции характеризует степень тесноты линейной зависимости между случайными величинами.

Для определения коэффициента корреляции имеется несколько методов. Однако мы приведем пример с использованием коэффициента корреляции смешанных моментов Пирсона, где

с применением таблицы данных (в нашем примере относительного содержания Т-лимфоцитов в % и уровня IgG в г/л):

Подставив полученные значения в формулу (4), получим

Т.е., коэффициент корреляции динамики Т-лимфоцитов и иммуноглобулина G у детей при перитонитах равен 0,9933, что говорит о высокой связи между данными показателями.

В главе 5 мы ввели в рассмотрение числовые характеристики одной случайной величины - начальные и центральные моменты различных порядков. Из этих характеристик важнейшими являются две: математическое ожидание и дисперсия .

Аналогичные числовые характеристики - начальные и центральные моменты различных порядков - можно ввести и для системы двух случайных величин.

Начальным моментом порядка , системы называется математическое ожидание произведения на :

![]() . (8.6.1)

. (8.6.1)

Центральным моментом порядка системы называется математическое ожидание произведения -й и -й степени соответствующих центрированных величин:

,

(8.6.2)

,

(8.6.2)

Выпишем формулы, служащие для непосредственного подсчета моментов. Для прерывных случайных величин

![]() , (8.6.3)

, (8.6.3)

, (8.6.4)

, (8.6.4)

где ![]() - вероятность того, что система примет значения , а суммирование

распространяется по всем возможным значениям случайных величин , .

- вероятность того, что система примет значения , а суммирование

распространяется по всем возможным значениям случайных величин , .

Для непрерывных случайных величин:

, (8.6.5)

, (8.6.5)

,

(8.6.6)

,

(8.6.6)

где - плотность распределения системы.

Помимо и , характеризующих порядок момента по отношению к отдельным величинам, рассматривается еще суммарный порядок момента , равный сумме показателей степеней при и . Соответственно суммарному порядку моменты классифицируются на первые, вторые и т. д. На практике обычно применяются только первые и вторые моменты.

Первые начальные моменты представляют собой уже известные нам математические ожидания величин и , входящих в систему:

Совокупность математических ожиданий представляет собой характеристику положения системы. Геометрически это координаты средней точки на плоскости, вокруг которой происходит рассеивание точки .

Кроме первых начальных моментов, на практике широко применяются еще вторые центральные моменты системы. Два из них представляют собой уже известные нам дисперсии величин и :

характеризующие рассеивание случайной точки в направлении осей и .

Особую роль как характеристика системы играет второй смешанный центральный момент:

,

,

т.е. математическое ожидание произведения центрированных величин.

Ввиду того, что этот момент играет важную роль в теории, введем для него особое обозначение:

. (8.6.7)

. (8.6.7)

Характеристика называется корреляционным моментом (иначе - «моментом связи») случайных величин , .

Для прерывных случайных величин корреляционный момент выражается формулой

![]() , (8.6.8)

, (8.6.8)

а для непрерывных - формулой

. (8.6.9)

. (8.6.9)

Выясним смысл и назначение этой характеристики.

Корреляционный момент есть характеристика системы случайных величин, описывающая, помимо, рассеивания величин и , еще и связь между ними. Для того чтобы убедиться в этом, докажем, что для независимых случайных величин корреляционный момент равен нулю.

Доказательство проведем для непрерывных случайных величин. Пусть , - независимые непрерывные величины с плотностью распределения . В 8.5 мы доказали, что для независимых величин

![]() . (8.6.10)

. (8.6.10)

где , - плотности распределения соответственно величин и .

Подставляя выражение (8.6.10) в формулу (8.6.9), видим, что интеграл (8.6.9) превращается в произведение двух интегралов:

.

.

Интеграл

представляет собой не что иное, как первый центральный момент величины , и, следовательно, равен нулю; по той же причине равен нулю и второй сомножитель; следовательно, для независимых случайных величин .

Таким образам, если корреляционный момент двух случайных величин отличен от нуля, это есть признак наличия зависимости между ними.

Из формулы (8.6.7) видно, что корреляционный момент характеризует не только зависимость величин, но и их рассеивание. Действительно, если, например, одна из величин весьма мало отклоняется от своего математического ожидания (почти не случайна), то корреляционный момент будет мал, какой бы тесной зависимостью ни были связаны величины . Поэтому для характеристики связи между величинами в чистом виде переходят от момента к безразмерной характеристике

где , - средние квадратические отклонения величин , . Эта характеристика называется коэффициентом корреляции величин и . Очевидно, коэффициент корреляции обращается в ноль одновременно с корреляционным моментом; следовательно, для независимых случайных величин коэффициент корреляции равен нулю.

Случайные величины, для которых корреляционный момент (а значит, и коэффициент корреляции) равен нулю, называются некоррелированными (иногда – «несвязанными»).

Выясним, эквивалентно ли понятие некоррелированности случайных величин понятию независимости. Выше мы доказали, что две независимые случайные величины всегда являются некоррелированными. Остается выяснить: справедливо ли обратное положение, вытекает ли из некоррелированности величин их независимость? Оказывается - нет. Можно построить примеры таких случайных величин, которые являются некоррелированными, но зависимыми. Равенство нулю коэффициента корреляции - необходимое, но не достаточное условие независимости случайных величин. Из независимости случайных величин вытекает их некоррелированность; напротив, из некоррелированности величин еще не следует их независимость. Условие независимости случайных величин – более жесткое, чем условие некоррелированности.

Убедимся в этом на примере. Рассмотрим систему случайных величин , распределенную с равномерной плотностью внутри круга радиуса с центром в начале координат (рис.8.6.1).

Плотность распределения величин выражается формулой

Из условия  находим .

находим .

Нетрудно убедиться, что в данном примере величины являются зависимыми. Действительно, непосредственно ясно, что если величина приняла, например, значение 0, то величина может с равной вероятностью принимать все значения от до ; если же величина приняла значение , то величина может принять только одно-единственное значение, в точности равное нулю; вообще, диапазон возможных значений зависит от того, какое значение приняла .

Посмотрим, являются ли эти величины коррелированными. Вычислим корреляционный момент. Имея в виду, что по соображениям симметрии , получим:

. (8.6.12)

. (8.6.12)

Для вычисления интеграла разобьем область интегрирования (круг ) на четыре сектора , соответствующие четырем координатным углам. В секторах и подынтегральная функция положительна, в секторах и - отрицательна; по абсолютной же величине интегралы по этим секторам равны; следовательно, интеграл (8.6.12) равен нулю, и величины не коррелированы.

Таким образом, мы видим, что из некоррелированности случайных величин не всегда следует их независимость.

Коэффициент корреляции характеризует не всякую зависимость, а только так называемую линейную зависимость. Линейная вероятностная зависимость случайных величин заключается в том, что при возрастании одной случайной величины другая имеет тенденцию возрастать (или же убывать) по линейному закону. Эта тенденция к линейной зависимости может быть более или менее ярко выраженной, более или менее приближаться к функциональной, т. е. самой тесной линейной зависимости. Коэффициент корреляции характеризует степень тесноты линейной зависимости между случайными величинами. Если случайные величины и связаны точной линейной функциональной зависимостью:

то , причем знак «плюс» или «минус» берется в зависимости от того, положителен или отрицателен коэффициент . В общем случае, когда величины и связаны произвольной вероятностной зависимостью, коэффициент корреляции может иметь значение в пределах: меняется только диапазон изменения , а его среднее значение не меняется; естественно, величины оказываются некоррелированными.

Рис. 8.6.2 Рис.8.6.3

Приведем несколько примеров случайных величин с положительной и отрицательной корреляцией.

1. Вес и рост человека связаны положительной корреляцией.

2. Время, потраченное на регулировку прибора при подготовке его к работе, и время его безотказной работы связаны положительной корреляцией (если, разумеется, время потрачено разумно). Наоборот, время, потраченное на подготовку, и количество неисправностей, обнаруженное при работе прибора, связаны отрицательной корреляцией.

3. При стрельбе залпом координаты точек попадания отдельных снарядов связаны положительной корреляцией (так как имеются общие для всех выстрелов ошибки прицеливания, одинаково отклоняющие от цели каждый из них).

4. Производится два выстрела по цели; точка попадания первого выстрела регистрируется, и в прицел вводится поправка, пропорциональная ошибке первого выстрела с обратным знаком. Координаты точек попадания первого и второго выстрелов будут связаны отрицательной корреляцией.

Если в нашем распоряжении имеются результаты ряда опытов над системой случайных величин , то о наличии или отсутствии существенной корреляции между ними легко судить в первом приближении по графику, на котором изображены в виде точек все полученные из опыта пары значений случайных величин. Например, если наблюденные пары значений величин расположились так, как показано на рис. 8.6.2, то это указывает на наличие явно выраженной положительной корреляции между величинами. Еще более ярко выраженную положительную корреляцию, близкую к линейной функциональной зависимости, наблюдаем на рис. 8.6.3. На рис. 8.6.4 показан случай сравнительно слабой отрицательной корреляции. Наконец, на рис. 8.6.5 иллюстрируется случай практически некоррелированных случайных величин. На практике, перед тем, как исследовать корреляцию случайных величин, всегда полезно предварительно построить наблюденные пары значений на графике для первого качественного суждения о типе корреляции.

Определение:

Корреляционным моментом случайных величин и называют математическое ожидание произведения отклонений этих величин

Напомним, что приведенное выражение является элементом формулы дисперсии суммы двух случайных величин:

Замечание:

Корреляционный момент может быть представлен в виде:

Доказательство:

Теорема:

Корреляционный момент двух независимых случайных величин и равен 0

Доказательство:

Согласно замечанию:

Но для независимых случайных величин

Тогда для независимых случайных величин и :

Определение:

Безразмерная величина называется коэффициентом корреляции.

Теорема:

Абсолютная величина корреляционного момента двух случайных величин не превосходит произведения их средних квадратических отклонений:

Доказательство:

Введем в рассмотрение случайную величину ![]() и найдем ее дисперсию:

и найдем ее дисперсию:

Так как любая дисперсия неотрицательная

Аналогично введем случайную величину ![]() и найдем, что:

и найдем, что:

Определение:

Случайные величины и называются некоррелированными, если , и коррелированными, если .

Теорема:

Коэффициент корреляции случайных величин, связанных линейной зависимостью, равен .

Доказательство:

Найдем коэффициент корреляции:

Отметим некоторые свойства коэффициента корреляции.

1. Из примера 1 следует, что если - независимые случайные величины, то коэффициент корреляции равен 0.

Заметим, что обратное утверждение неверно.

2. Абсолютная величина коэффициента корреляции в общем случае не превосходит единицы:

Доказательство следует из доказанной ранее формулы для корреляционного момента:

Разделим обе части неравенства на произведение и получим

3. Коэффициент корреляции характеризует относительную (в долях ) величину отклонения математического ожидания произведения от произведения математических ожиданий величин . Так как такое отклонение имеет место только для зависимых величин, то можно сказать, что коэффициент корреляции характеризует тесноту зависимости между и .

Это утверждение следует из доказанного ранее равенства: . Приведем корреляционный момент к коэффициенту корреляции:

Куликов А. А. Форекс для начинающих. Справочник биржевого спекулянта – СПб.: Питер, 2007; Коммерсантъ № 62 от 13.04.2007 – Мировая торговля замедлится.

Bachelier L. Theorie de la speculation. //Annales de l"Ecole Normale Superieure. 1900. V. 17. P. 21-86. Описание идей Л. Бушелье, их судьба и их современная критика содержатся в книгах: Мандельброт Б. Непослушные рынке, фрактальная революция в финансах – пер. с англ. – М.: Издательский дом «Вильямс», 2006; Сорнетте Д. Как предсказывать крахи финансовых рынков – пер. с франц. – М.: Издательство «И-трейд», 2008.

Cootner Paul H. The Random Character of Stock Market Prices – Cambridge, MA, MIT Press

Harry M. Markowitz, Portfolio Selection, Journal of Finance, 7, no 1 (March 1952), pp, 79-81.

В представленном разделе используются материалы следующих книг: Шарп У. Ф.., Александер Г. Дж., Бэйли Дж. В. Инвестиции – пер. с англ. – М.: ИНФРА-М, 1997; Бромвич М. Анализ экономической эффективности капиталовложений – пер. с англ. – М.: ИНФРА-М, 1996; Ширяев В. И. Модели финансовых рынков. Оптимальные портфели, управление финансами и рисками – Учебное пособие – М.: КомКнига, 2007; Шаповал А. Б. Инвестиции: математические методы – М.: ФОРУМ: ИНФРА-М, 2007; Коростелева М. В. Методы анализа рынка капитала – СПб.: Питер, 2003.

Тобин Дж. обратил внимание на недостаточность показателей математических ожиданий и дисперсии для сравнения портфелей (См. Ширяев В. И. Модели финансовых рынков… - стр. 18-19). Тем не менее, их применение оправдано своей конструктивностью.

См. Аскинадзи В. М. и др. Инвестиционное дело – Учебник - М.: Маркет ДС, 2007, стр. 238-241 или Ширяев В. И. Модели финансовых рынков. Оптимальные портфели, управление финансами и рисками – Учебное пособие – М.: КомКнига, 2007, стр. 17.

См. Бромвич М. Анализ экономической эффективности капиталовложений – пер. с англ. – М.: ИНФРА-М, 1996, стр. 343. Обсуждение альтернативных мер риска, например, приведение к нормальному типу так называемого логнормального распределения можно найти в книге: Шарп У. Ф.., Александер Г. Дж., Бэйли Дж. В. Инвестиции – пер. с англ. – М.: ИНФРА-М, 1997, стр. 179-181.

См. Бромвич М. Ук. Соч. стр. 342.

Считают, что первым шагом в создании теории полезности было формулирование так называемого Санкт-Петербургского парадокса. Любопытно, что сформулировал этот парадокс Николай Бернулли, а объяснение дал ему Даниил Бернулли - См.: Бернулли Д. Опыт новой теории измерения жребия / Д. Бернулли; пер. А. Нардовой // Вехи экономической мысли / сост. и общ. ред. В. М. Гальперина. Спб., 1993. Т. 1: Теория потребительского поведения и спроса. С. 11-27.

Полезные материалы по теории полезности можно найти в книгах, посвященных теории игр, в частности: Льюс Р.Д., Райфа Х. Игры и решения - Пер. с англ. - М.: Изд-во иностр. лит., 1961; Нейман фон Джон, Моргенштерн О. Теория игр и экономическое поведение - Пер. с англ. - М.: Наука, 1970.

См. Приложение к модели Г. Марковица

См. в книге Ширяева В. И. Модели финансовых рынков. Оптимальные портфели, управление финансами и рисками – М.: КомКнига, 2007, стр. 25-26.

Аналитическую формулировку модели Марковица можно найти в книгах: Шаповал А. Б. Инвестиции: математические методы – М.: ФОРУМ: ИНФРА-М, 2007, стр. 21-22; Аскинадзи В. М. и др. Инвестиционное дело – Учебник - М.: Маркет ДС, 2007, стр. 288.

Нами использованна формулировка, предложенная в книге: Аскинадзи В. М. и др. Инвестиционное дело – Учебник - М.: Маркет ДС, 2007, стр. 256-257.

См. в книге: Шаповал А. Б. Инвестиции: математические методы – М.: ФОРУМ: ИНФРА-М, 2007, стр. 16-18 (раздел «Модель Марковица»).

См.:Шарп У. Ук. соч. стр. 213-218, 226-228, стр. 271 – о связи и отличиях рыночной модели и модели САРМ; также Аскинадзи В. М. и др. Ук. соч., стр. 278-294; Ширяев В. В. Ук. соч., стр. 47-58

См.: Шарп У. Ф., Александер Г. Дж., Бэйли Дж. В. Инвестиции –пер. с англ. – М.: ИНФРА-М, 1997, стр 316-337.

См.: Оценка бизнеса – под ред. Грязновой А.Г., Федотовой М.А. – М.: Финансы и статистика, 2007, стр. 199

См: Шаповал А. Б. Инвестиции: математические методы – М.: ФОРУМ: ИНФРА-М, 2007, глава 3.

См. Мандельброт Б., Хадсон Р. Л. Непослушные рынки: фрактальная революция в финансах – пер. с англ. – М.: Издательский дом «Вильямс», 2006, 187 стр.

См. там же, стр. 34-39.

См.: Сорнетте Д. Как предсказывать крахи финансовых рынков – пер. с франц. – М.: Издательство «И-трейд», 2008, стр. 19-22.

Это раздел основан, главным образом, на материалах книги: Экономическая теория (New Palgraiv) – пер. с англ. – М.: ИНФРА-М, 2004, стр. 263-273 – глава Гипотеза эффективного рынка, автор - Бертон Мэлкил (Berton G, Malkiel). Ссылки на авторов различных исследований также сделаны по материалам этой статьи. См. также: Бертон Мэлкил «Случайная прогулка по Уолл-Стрит – пер. с англ. - Минск: Попурри, 2006. Последняя книга издается уже 30 лет. Любопытно, что в конце 90-х годов вышла иная книга: Эндрю Лоу. Неслучайная прогулка по Уолл-Стрит. Б. Мелкил является, в целом, сторонником гипотезы эффективного рынка, а Эндрю Лоу – наоборот.

См.: Чеботарев Ю.Н. Случайность и Неслучайность биржевых цен – М.: СмартБук; И-трейд, 2008, 198.

Инвариантность - неизменность какой-либо величины при изменении физических условий или по отношению к некоторым преобразованиям, например, преобразованиям координат и времени при переходе от одной инерциальной системы отсчета к другой (релятивистская инвариантность). Практически строгое описание «случайного блуждания» в наиболее простой версии «винеровского процесса» можно найти в книге: Шаповал А.Б. Инвестиции: математические методы – Учебное пособие – М.: ФОРУМ: ИНФРА-М, 2007, стр. 42-43.

Случайный процесс называется винеровским, если выполнены следующие условия:

1) Процесс начинается с нуля, то есть;

2) Случайная величина имеет нормальное распределение с нулевым математическим ожиданием и с дисперсией равной для любого момента времени;

3) Для произвольных непересекающихся интервалов и случайные величины и независимы.

Вообще, пособие Шаповала А.Б. мы рекомендуем для ознакомления с математическими моделями портфельного анализа, оценки опционов. Изложение достаточно строгое для практики и краткое (96 стр.), но вводит в современную теорию финансов. В главе о портфельном анализе мы в значительной мере используем

См. материал из Википедии:

Последовательность случайных величин называется мартингалов с дискретным временем, если:

Пусть дана другая последовательность случайных величин. Тогда последовательность случайных величин называется мартингалом относительно или -мартингалом, если:

Пусть дана последовательность случайных величин. Тогда последовательность случайных величин называется суб(супер) мартингалом относительно, если:

Этот эффект можно объяснить налоговым влиянием. В конце года инвесторы сбрасывают акции, в первую очередь, мелких фирм для имитации убыточности и облегчения налоговых платежей, цены акций падают, а в январе они могут вернуться даже с излишком вверх – См.: Бертон Мэлкил. Случайная прогулка по Уолл-Стрит, стр. 316-317.

Эффект уик-энда, эффект понедельника не имеет однозначного объяснения. Эффект говорит о том, что цены акций в понедельник ниже, чем вечером в пятницу. В книге «Случайная прогулка по Уолл-Стрит» Бертон Мэлкил уточняет эффект: цены акций утром в понедельник немного выше, чем вечером в пятницу, а к вечеру понедельника они понижаются, так что доходность становится относительно отрицательной. Поэтому следует покупать акции в понедельник вечером. Но проверка эффекта, проведенная автором по материалам Нью-Йоркской фондовой биржи с мая по июль 2002 года показала, что эффект проявился лишь в восьми уик-эндах из тринадцати.

Стратегию «купил и держи» реализуют так называемые «индексные фонды», которые держат структуру своих вложений в соответствии с популярными биржевыми индексами. По данным информационного портала «Вложи.ру», в России в 2007 году действовало 11 ПИФов как индексные фонды. Первый российский индексный фонд был образован в 2003 году. В США такие фонды действуют уже 30 лет. Российские фонды ориентируются на индексы ММВБ или РТС (после модификации в 2006 году индекс РТС стал учитывать и ликвидность бумаг, что требуется для правильной работы индексного фонда). Строго следовать индексам индексные фонды, конечно, не могут, так как было бы нерационально вносить изменения во вложения непрерывно. См. материалы об индексных фондах на портале частного инвестора «Вложи.ру»: http://www.vlozhi.ru/

Дробление акций снижает их номинальную стоимость, в результате чего она становится более доступной мелким акционерам. Расширение рынка акций может повысить к ним интерес и, соответственно, увеличить спрос на них, а значит, и рыночную стоимость акций

Эффективность взаимных фондов относительно эффективности индексных акций за 1980-1990 годы см.: Бертон Мэлкил. Случайная прогулка по Уолл-Стрит, стр. 238. В 80-е годы взаимные фонды обгоняли индекс S&P 500, в 90-е годы – отставали. Там же и другие современные материалы по эффективности взаимных фондов. Например, по данным с 1968 по 2002 годы проведено сопоставление доли наличности в активах взаимных фондов и индекса S&P 500. Сопоставление показало, что доля наличности в активах фондов была высока именно в те моменты, когда индекс был низок, то есть когда надо было, наоборот, тратить наличные деньги на покупку акций – стр. 244-248.

Результаты расчетов см.: Бертон Мэлкил. Случайная прогулка по Уолл-Стрит, стр. 235.

См. номера журнала «Финанс» за 2009-2010 годы.

См. Элдер А. Как играть и выигрывать на бирже: Психология. Технический анализ. Контроль над капиталом – М.: Альпина Бизнес Бук, 2007, стр. 29-35.

См.: Дамодаран А. Инвестиционные байки: разоблачение мифов о безпроигрышных биржевых стратегиях – пер. с англ. СПб.: Питер, 2007, стр. 396-428.

См.: Хэгстром Р. Дж. Инвестирование. Последнее свободное искусство – пер. с англ. – М.: ЗАО «Олимп-Бизнес», 2005.

Сравнение среднегодовой доходности и риска (квадратичного отклонения доходности) акций компаний крупных и мелких за период с 1926-2001 показало, что среднегодовая доходность акций мелких компаний – 17.5%, а крупных – 12.4 при риске 35.3 и 20.8%% соответственно. Среднеожидаемый ежемесячный доход за период 1963-1990 годы также показывает зависимость от размера компании. В то же время в 90-е годы ситуация изменилась, большие доходы стали давать компании с высокой капитализацией. Дело, по-видимому, в том, что выросла доля институциональных инвесторов, работающих с акциями крупных компаний, и акции мелкий компаний потеряли часть ликвидности – См. Бертон Мэлкил. Случайная прогулка по Уолл-Стрит, стр. 265, 333-334.

Данные за 80-е годы показывают, что акции с низким коэффициентом доходности (отношение цены акции к чистой прибыли компании) показывали более высокую доходность. Аналогично, акции с низким оотношением цены к стоимости активов фирмы дают обычно большую доходность – См. Бертон Мэлкил. Случайная прогулка по Уолл-Стрит, стр. 334-340.

Доказательства приведены по материалам книги: Бромвич Майкл. Анализ экономической эффективности капиталовложений – М.: ИНФРА-М, 1996.

См. Б.В. Гнеденко. Курс теории вероятности – М.: Наука, 1969, стр. 179 (глава 5. Числовые характеристики случайных величин)

4 страницы (Word-файл)

Посмотреть все страницы

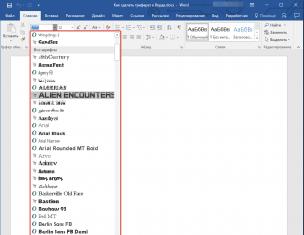

Фрагмент текста работы

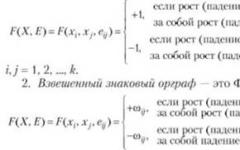

где ![]()

для дискретных случайных величин Хи У и

![]() , y)dxdy

, y)dxdy

для непрерывных случайных величин,

Корреляционный момент служит для характеристики связи между случайными величинами. В частности, для независимых случайных величин Х и У корреляционный момент Сху равен нулю.

По определению корреляционный момент имеет размерность, равную произведению размерностей величин Х и У. Это значит, что величина корреляционного момента зависит от единиц измерения случайных величин. Например, если при измерении величин Х и У в сантиметрах получилось С». 2 см2, то при измерении Х и У в миллиметрах получим Сху = 200 мм2. Такая зависимость корреляционного момента от единиц измерения затрудняет сравнение различных систем случайных величин. Чтобы устранить этот недостаток, вводится безразмерная характеристика rry связи между величинами Х и У, называемая коэффициентом корреляции:

Если случайные величины Х и У независимы, то r», = О. Если же случайные величины Хи У связаны точной линейной зависимостью У = ах + Ь, то rxy= l при а>О и Ъ. = - при а z О. Вообще же справедливо двойное неравенство -1 S rxyS

Свойство независимости двух случайных величин Х и У в общем случае не равносильно их некоррелированности (т.е. равенству rn. = 0). Однако для нормально распределенных составляющих двумерной случайной величины это так.

Закон распределения системы двух дискретных случайных величин (Х, Л задан следующей таблицей

) законы распределения случайных величин Х и У;

2) условный закон распределения случайной величины Х при условии, что У = 1;

3) математические ожидания ИХ), Ц У) и центр рассеивания;

4) дисперсии D(X) и ДУЭ;

5) корреляционный момент Сду и коэффициент корреляции Ъ.

1. Сложив вероятности по строкам, получаем вероятности возможных значений случайной величины Х: = 0,4, p(l) = 0,2, р(4) = 0,4. Следовательно, закон распределения величины Х имеет следующий вид

Проверка: 0,4 + 1.

Сложив вероятности по столбцам, получаем вероятности возможных значений случайной величины У: = 0,1, p(l) = 0,3, АЗ) = 0,6. Напишем закон распределения величины У

Проверка: (),l + 0,3 + 0,6 =

2.

Найдем

условные вероятности для случайной величины Х при условии, что У = У-2 = 1:

p(-l f 1) = -Р12

Найдем

условные вероятности для случайной величины Х при условии, что У = У-2 = 1:

p(-l f 1) = -Р12

Так как распределения (Х 1 У = 1) имеет следующую таблицу

З. Исходя из определения, вычисляем математические ожидания:

5. Составим таблицу системы чентривжанных случайных величин

х, У, где У=У-т = У -1,9

Вычислим корреляционный момент:

(-3,9) 0-2,4 (-0,9)

(-3,9) 0-2,4 (-0,9)

Система двух непрерывных случайных величин (Х, У) имеет равномерное распределение в области D = «х, у) - S х S 3, О S у S х + l} .

) плотность распределения;

2) вероятность Ч Х, У) с попадания в область

3) плотностиЛ(х) и Ку) распределения случайных величин Х и У, а также условные плотности и y(ylx);

4) функции и F20) распределения случайных величин Х и У;

5) математические ожидания М(Х), и центр рассеивания;

6) дисперсии и Ц У);

7) корреляционный момент Сл. и коэффициент корреляции

1. По условию функция плотности имеет вид а, если -lSxS3 и 0SySx+l, О, если (х, у) Е Д

Для нахождения параметра а воспользуемся соотношением f(x, y)dy.dy = , где обл5сть интегрирования D изображена на рис. 7.

|

|

||||||||||||

Область D ограничена слева и справа прямыми х = -1 и х = 3, а снизу и сверху - прямыми О и У2(х) = х + 1. Переходя к повторному интегралу, имеем:

3

3

fady= гаур Х +1 Д = fa(x + l)dx =

8а. Так как 8а = 1, ТО а з- и функция ПлОтнОсТи 8

имеет вид

![]() -, если

-, если

О, если (х,у) Е).

2. Изобразим область G, которая представляет собой круг радиуса 2 с центром в точке (2, О) (см. рис. 8). Так как функция Ах, у) равна нулю вне

3. Найдем плотностиЛ(х) илу):

поэтому

поэтому

Следовательно,

Для О S у S 4 аналогично получаем