Находя максимальное значение энтропии, мы получаем совершенно аналогично классическому случаю закон распределения молекул по энергетическим уровням.

И обозначает максимальное значение энтропии.

При наличии максимального значения энтропии Н (х, у) система не имеет никакой организации и значения величин х и у не связаны между собой.

Доказать необходимость максимального значения энтропии для равновесного состояния системы на основе обобщенного уравнения термодинамики невозможно. Однако равновесие невозможно при немаксимальном значении энтропии.

Формула (1.1) выражает максимальное значение энтропии (1.8); когда все возможные состояния системы равновероятны, она наиболее неупо-рядоченна, а следовательно, ее энтропия должна иметь наибольшее значение.

Другими словами, максимальное значение энтропии коррозионной пары с конечным числом состояний равно логарифму этого числа и достигает Smax тогда, когда все состояния равновероятны. В случае, если состояния коррозионной пары известны заранее, то ее энтропия равна нулю.

Состояние системы с максимальным значением энтропии и есть состояние устойчивого равновесия. Действительно, в этом состоянии в системе необратимые процессы протекать не могут, так как в противном случае энтропия системы должна была бы возрастать, чего быть не может.

Так как состояние равновесия отвечает максимальному значению энтропии, а потоки в этом состоянии исчезают, то все параметры в равновесном состоянии обращаются в нуль.

Метастабильное состояние равновесия характеризуется также максимальным значением энтропии (и минимумами энергии и термодинамических потенциалов), но для системы возможны и другие состояния равновесия, в которых при тех же значениях энергии, объема и количеств веществ энтропия имеет еще большие значения.

Если термодинамическое равновесие, которое соответствует максимальному значению энтропии, имеет лишь статистическую природу, то следует ожидать отклонений от наиболее вероятных значений при наблюдениях в очень малых областях. С этими флуктуациями плотности связано рассеяние света в атмосфере, в частности цвет неба; теория этого явления позволяет вычислить число Авогадро из спектрального распределения интенсивности рассеянного света. Если в жидкости имеются малые, но все же заметные под микроскопом частицы (коллоидные частицы), то видно их нерегулярное дрожание, обусловленное тем, что удары молекул жидкости с разных сторон не в точности уравновешиваются в каждое мгновение: то с одной, то с другой стороны частицу ударяет большее число молекул, и она смещается в соответствующем направлении. Сущность этого явления, названного броуновским движением (в честь английского ботаника Броуна), долго оставалась неясной. Но под микроскопом наблюдается скорость, на много порядков меньшая, если определять ее обычным образом как отношение пути ко времени. В действительности же скорость частицы столь часто меняет свое направление, что наблюдаемое движение такой частицы представляет собой лишь грубое приближение истинного зигзагообразного движения.

Если система находится в состоянии равновесия, характеризующемся максимальным значением энтропии, то наиболее вероятными будут процессы, при которых энтропия системы не изменяется. Из сопоставления этих выводов со вторым началом термодинамики видна их эквивалентность.

В данном примере (при двух возможных исходах) максимальное значение энтропии равно одной двоичной единице.

При этом следует учесть, что распределение Флори дает максимальное значение энтропии.

Изменение энтропии изолированной системы конечных размеров.

Система в основном находится в равновесном состоянии, отвечающем максимальному значению энтропии системы; отклонившись от этого состояния, система затем возвращается к нему. При наблюдении системы продолжительное время можно отметить, что случаи увеличения и уменьшения энтропии встречаются одинаково часто, причем время повторяемости какого-либо отклонения системы от равновесного состояния тем больше, чем меньше вероятность данного неравновесного состояния. С увеличением размеров системы время повторяемости быстро возрастает. Поэтому процессы, являющиеся необратимыми с точки зрения обычной термодинамики, представляются практически необратимыми и со статистической точки зрения. Указанное обстоятельство сближает обе формулировки второго начала термодинамики и практически снимает отмеченное выше и различие.

Докажем для простейшего случая (для однофазной системы), что максимальное значение энтропии или минимальное значение свободной энергии системы соответствуют равнораспределению изотопов. Пусть далее в соединении АХ содержится а р п атомов элемента X, участвующего в обмене.

Можно показать, что при заданной дисперсии состояний о распределение по нормальному закону дает максимальное значение энтропии.

Самопроизвольные процессы в изолированных системах могут протекать лишь в сторону возрастания энтропии, а равновесию соответствует максимальное значение энтропии.

Вводя скорости и рассматривая неравновесные состояния, представляющие собой организмы, мы лишаемся такого надежного критерия, как максимальное значение энтропии, и должны попытаться найти другие основания для отбора состояний, являющихся устойчивыми.

Температуры стеклования и плавления ряда полимеров, области их применения. При деформации такой системы суммарная величина статистической неупорядоченности уменьшается, поэтому система стремится возвратиться к состоянию, которому отвечает максимальное значение энтропии.

Глубина самопроизвольных процессов определяется величиной энтропии каждого из тел, между которыми осуществляется какой-либо процесс, прекращающийся при достижении максимального значения энтропии, после чего система вступает в тепловое равновесное состояние, выйти из которого самопроизвольно не может.

Молекулярно-массовое распределение полигексаметиленадипамида по. При выводе этого уравнения принимается основное допущение о независимости реакционной способности молекул от величины молекулярной массы, а также допущения о максимальном значении энтропии для данного равновесного фракционного состава, об изменении фракционного состава при данной средней молекулярной массе только за счет изменения энтропии.

Равновесию гетерогенных систем отвечает равенство химических потенциалов каждого компонента во всех фазах, а также минимальное значение изохорного или изобарного потенциалов или максимальное значение энтропии всей системы при определенных условиях. Если в систему входит хотя бы одна фаза, состав которой изменяется в процессе приближения к равновесию, то равновесное состояние фазы и всей системы характеризуется константой равновесия, например в системах, состоящих из индивидуальных веществ в конденсированном состоянии и газов. В системах, состоящих из индивидуальных веществ в конденсированном состоянии, в которых состав фаз в ходе процесса не изменяется, а процесс идет до полного исчезновения одного из исходных веществ (например, полиморфные превращения веществ), понятие константы равновесия неприменимо.

Равновесию гетерогенных систем отвечает равенство химических потенциалов каждого компонента во всех фазах, а также минимальное значение одного из термодинамических потенциалов или максимальное значение энтропии всей системы при соответствующих условиях. Наиболее обычными условиями на практике являются постоянная температура и постоянное давление, поэтому мы будем оценивать равновесие гетерогенных систем по их изобарному потенциалу.

Принимая во внимание молекулярную природу рабочего вещества и флуктуации в нем внутренних параметров, можно отметить, что без установления равновесия в системе максимальное значение энтропии невозможно достигнуть. Флуктуации приводят систему к равновесию. Именно флуктуации в системах приводят к необходимости максимума энтропии при равновесии всякий раз, когда это условие не выполняется, то есть система выведена из равновесия.

Таким образом, основная причина упругости при деформации в высокоэластическом состоянии и возникновения напряжений в образце заключается в изменении конформации и переходе из равновесной формы статистического клубка с максимальным значением энтропии в неравновесную с уменьшением энтропии и обратный переход после прекращения деформации. Вклад энергетической составляющей в этот процесс невелик, а для идеальных сеток равен нулю.

ТЕПЛОВАЯ СМЕРТЬ ВСЕЛЕННОЙ - конечное состояние мира, к-рое якобы возникает в результате необратимого превращения всех форм движения в тепловую, рассеяния теплоты в пространстве и перехода мира в состояние равновесия с максимальным значением энтропии. Этот вывод делается на основе абсолютизации второго закона термодинамики и распространения его на всю вселенную.

ТЕПЛОВАЯ СМЕРТЬ ВСЕЛЕННОЙ - конечное состояние мира, к-рое якобы возникает в результате необратимого превращения всех форм движения в тепловую, рассеяния теплоты в пространстве и перехода мира в состояние равновесия с максимальным значением энтропии. Этот вывод делается на основе абсолютизации второго закона термодинамики и распространения его на всю вселенную. Образование звезд и галактик является одним из проявлений этого процесса. Необратимое изменение материи во вселенной не предполагает к.

Второе начало термодинамики устанавливает, что необратимые процессы (а такими являются практически все тепловые процессы и во всяком случае все естественно протекающие процессы) идут так, что энтропия системы тел, участвующих в процессе, растет, стремясь к максимальному значению. Максимальное значение энтропии достигается тогда, когда система приходит в состояние равновесия.

Свойство энтропии возрастать в необратимых процессах, да и сама необратимость находятся в противоречии с обратимостью всех механических движений и поэтому физический смысл энтропии не столь очевиден, как, например, физический смысл внутренней энергии. Максимальное значение энтропии замкнутой системы достигается тогда, когда система приходит в состояние термодинамического равновесия. Такая количественная формулировка второго закона термодинамики дана Клаузиусом, а ее молекулярно-кинетическое истолкование Больцманом, который ввел в теорию теплоты статистические представления, основанные на том, что необратимость тепловых процессов имеет вероятностный характер.

Соотношение (IX.2) выражает тот факт, что для состояния равновесия изолированной системы имеется условный максимум энтропии. Максимальное значение энтропии изолированной системы определяется заданными значениями энергии и объема системы, а также масс, а следовательно, и числа молей компонентов.

Рост энтропии в любом процессе продолжается не беспредельно, а лишь до определенного максимального значения, характерного для данной системы. Это максимальное значение энтропии соответствует состоянию равновесия, и после того, как оно достигнуто, какие бы то ни было изменения состояния без внешнего воздействия прекращаются.

Рост энтропии в любом процессе продолжается не беспредельно, а лишь до определенного максимального значения, характерного для данной системы. Это максимальное значение энтропии соответствует состоянию равновесия, и после того, как оно достигнуто, ка-кие бы то ни было изменения состояния без внешнего воздействия прекращаются.

Таким образом, в случае равновероятности входных событий энтропия соответствует количеству информации для равновероятных исходов. Хартли соответствует максимальному значению энтропии. Физически это определяет случай, когда неопределенность настолько велика, что прогнозировать оказывается трудно.

Ншкс максимальная 2птропия, возможная для всех составов с данным числом компонентов. Очевидно, максимальным значением энтропии обладают составы, в которых все компоненты находятся в равных концентрациях.

Как видим, наибольшая термодинамическая вероятность получится тогда, когда молекулы равномерно распределятся по участкам. Этому равномерному распределению отвечает максимальное значение энтропии.

Более строгое развитие этого вопроса дается в статистической термодинамике. Отметим только, что максимальное значение энтропии, отвечающее состоянию равновесия, рассматривается лишь как наиболее вероятное. При достаточно большом промежутке времени возможны отклонения от него. В макросистемах для этого требуются времена астрономического порядка. В микроскопических объемах, внутри окружающих нас тел такие изменения происходят постоянно.

Отсюда ясно, что эти процессы будут продолжаться до тех пор, пока энтропия системы не достигнет максимума. Состояние изолированной системы с максимальным значением энтропии и есть состояние устойчи - - вого равновесия.

Отсюда ясно, что эти процессы будут продолжаться до тех пор, пока энтропия системы не достигнет максимума. Состояние изолированной системы с максимальным значением энтропии и есть состояние устойчи - вого равновесия.

Статистический характер закона возрастания энтропии вытекает из самого определения энтропии (III.70), связывающего эту функцию с вероятностью данного макроскопического состояния системы. Однако равновесное состояние, которому отвечает максимальное значение энтропии изолированной системы, наиболее вероятно, причем для макроскопических систем максимум является чрезвычайно резким. Равновесному состоянию макроскопической изолированной системы отвечает почти весь объем энергетического слоя, и изображающая точка системы с вероятностью, близкой к единице, находится Именно в этой области. Если система не находится в состоянии, которому отвечает равновесное значение макроскопического параметра X (с точностью до интервала ДХ), она почти наверняка придет к этому состоянию; если же система уже находится в этом состоянии, она очень редко будет выходить из него.

Статистический характер закона возрастания энтропии вытекает из самого определения энтропии (II 1.63), связывающего эту функцию с вероятностью данного макроскопического состояния системы. Однако равновесное состояние, которому отвечает максимальное значение энтропии изолированной системы, наиболее вероятно, причем для макроскопических систем максимум является чрезвычайно резким. Равновесному состоянию макроскопической изолированной системы отвечает почти весь объем энергетического слоя, и изображающая точка системы с ностью, близкой к единице, находится именно в этой области, система не находится в состоянии, которому отвечает равновесное значение макроскопического параметра X (с точностью до интервала АХ), она почти наверняка придет к этому состоянию; если же система уже находится в этом состоянии, она очень редко будет выходить из него.

Наиболее общие условия равновесия вытекают из утверждения второго закона термодинамики о росте энтропии адиабатически изолированной системы при протекании в ней необратимых процессов. Если некоторое состояние такой системы характеризуется максимальным значением энтропии, то это состояние не может быть неравновесным, так как иначе при релаксации энтропия системы согласно второму закону возрастала бы, что не согласуется с предположением о ее максимальности. Следовательно, условие максимальности энтропии изолированной системы является достаточным условием ее равновесности.

Любое сообщение, с которым мы имеем дело в теории информации, представляет собой совокупность сведений о некоторой физической системе. Например, на вход автоматизированной системы управления производственным цехом может быть передано сообщение о нормальном или повышенном проценте брака, о химическом составе сырья или температуре в печи. На вход системы управления средствами противовоздушной обороны может быть передано сообщение о том, что в воздухе находятся две цели, летящие на определенной высоте, с определенной скоростью. На тот же вход может быть передано сообщение о том, что на определенном аэродроме в данный момент находится такое-то количество истребителей в боевой готовности, или что аэродром выведен из строя огневым воздействием противника, или что первая цель сбита, а вторая продолжает полет с измененным курсом. Любое из этих сообщений описывает состояние какой-то физической системы.

Очевидно, если бы состояние физической системы было известно заранее, не было бы смысла передавать сообщение. Сообщение приобретает смысл только тогда, когда состояние системы заранее неизвестно, случайно.

Поэтому в качестве объекта, о котором передается информация, мы будем рассматривать некоторую физическую систему , которая случайным образом может оказаться в том или ином состоянии, т. е. систему, которой заведомо присуща какая-то степень неопределенности. Очевидно, сведения, полученные о системе, будут, вообще говоря, тем ценнее и содержательнее, чем больше была неопределенность системы до получения этих сведений («априори»). Возникает естественный вопрос: что значит «большая» или «меньшая» степень неопределенности и чем можно ее измерить?

Чтобы ответить на этот вопрос, сравним между собой две системы, каждой из которых присуща некоторая неопределенность.

В качестве первой системы возьмем монету, которая в результате бросания может оказаться в одном из двух состояний: 1) выпал герб и 2) выпала цифра. В качестве второй - игральную кость, у которой шесть возможных состояний: 1, 2, 3, 4, 5 и 6. Спрашивается, неопределенность какой системы больше? Очевидно, второй, так как у нее больше возможных состояний, в каждом из которых она может оказаться с одинаковой вероятностью.

Может показаться, что степень неопределенности определяется числом возможных состояний системы. Однако в общем случае это не так. Рассмотрим, например, техническое устройство, которое может быть в двух состояниях: 1) исправно и 2) отказало. Предположим, что до получения сведений (априори) вероятность исправной работы устройства 0,99, а вероятность отказа 0,01. Такая система обладает только очень малой степенью неопределенности: почти наверное можно предугадать, что устройство будет работать исправно. При бросании монеты тоже имеется два возможных состояния, но степень неопределенности гораздо больше. Мы видим, что степень неопределенности физической системы определяется не только числом ее возможных состояний, но и вероятностями состояний.

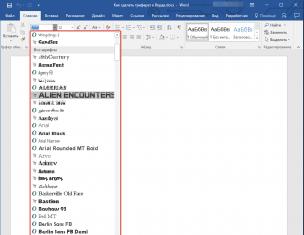

Перейдем к общему случаю. Рассмотрим некоторую систему , которая может принимать конечное множество состояний: с вероятностями , где

![]() (18.2.1)

(18.2.1)

Вероятность того, что система примет состояние (символом обозначается событие: система находится в состоянии ). Очевидно, .

Запишем эти данные в виде таблицы, где в верхней строке перечислены возможные состояния системы, а в нижней - соответствующие вероятности:

Эта табличка по написанию сходна с рядом распределения прерывной случайной величины с возможными значениями , имеющими вероятности . И действительно, между физической системой с конечным множеством состояний и прерывной случайной величиной много общего; для того чтобы свести первую ко второй, достаточно приписать каждому состоянию какое-то числовое значение (скажем, номер состояния). Подчеркнем, что для описания степени неопределенности системы совершенно неважно, какие именно значения записаны в верхней строке таблицы; важны только количество этих значений и их вероятности.

В качестве меры априорной неопределенности системы (или прерывной случайной величины ) в теории информации применяется специальная характеристика, называемая энтропией. Понятие об энтропии является в теории информации основным.

Энтропией системы называется сумма произведений вероятностей различных состояний системы на логарифмы этих вероятностей, взятая с обратным знаком:

. (18.2.2)

. (18.2.2)

Энтропия , как мы увидим в дальнейшем, обладает рядом свойств, оправдывающих ее выбор в качестве характеристики степени неопределенности. Во-первых, она обращается в нуль, когда одно из состояний системы достоверно, а другие - невозможны. Во-вторых, при заданном числе состояний она обращается в максимум, когда эти состояния равновероятны, а при увеличении числа состояний - увеличивается. Наконец, и это самое главное, она обладает свойством аддитивности, т. е. когда несколько независимых систем объединяются в одну, их энтропии складываются.

Логарифм в формуле (18.2.2) может быть взят при любом основании . Перемена основания равносильна простому умножению энтропии на постоянное число, а выбор основания равносилен выбору определенной единицы измерения энтропии. Если за основание выбрано число 10, то говорят о «десятичных единицах» энтропии, если 2 - о «двоичных единицах». На практике удобнее всего пользоваться логарифмами при основании 2 и измерять энтропию в двоичных единицах; это хорошо согласуется с применяемой в электронных цифровых вычислительных машинах двоичной системой счисления.

В дальнейшем мы будем везде, если не оговорено противное, под символом понимать двоичный логарифм.

В приложении (табл. 6) даны двоичные логарифмы целых чисел от 1 до 100.

Легко убедиться, что при выборе 2 в качестве основания логарифмов за единицу измерения энтропии принимается энтропия простейшей системы , которая имеет два равновозможных состояния:

Действительно, по формуле (18.2.2) имеем:

![]() .

.

Определенная таким образом единица энтропии называется «двоичной единицей» и иногда обозначается bit (от английского «binary digit» - двоичный знак). Это энтропия одного разряда двоичного числа, если он с одинаковой вероятностью может быть нулем или единицей.

Измерим в двоичных единицах энтропию системы , которая имеет равновероятных состояний:

![]()

т. е. энтропия системы с равновозможными состояниями равна логарифму числа состояний.

Например, для системы с восемью

состояниями ![]() .

.

Докажем, что в случае, когда состояние системы в точности известно заранее, ее энтропия равна нулю. Действительно, в этом случае все вероятности в формуле (18.2.2) обращаются в нуль, кроме одной - например , которая равна единице. Член обращается в нуль, так как . Остальные члены тоже обращаются в нуль, так как

![]() .

.

Докажем, что энтропия системы с конечным множеством состояний достигает максимума, когда все состояния равновероятны. Для этого рассмотрим энтропию системы (18.2.2) как функцию вероятностей и найдем условный экстремум этой функции при условии:

Пользуясь методом неопределенных множителей Лагранжа, будем искать экстремум функции:

. (18.2.5)

. (18.2.5)

Дифференцируя (18.2.5) по и приравнивая производные нулю, получим систему уравнений:

![]()

![]() , (18.2.6)

, (18.2.6)

откуда видно, что экстремум (в данном случае максимум) достигается при равных между собой значениях . Из условия (18.2.4) видно, что при этом

![]() , (18.2.7)

, (18.2.7)

а максимальная энтропия системы равна:

![]() , (18.2.8)

, (18.2.8)

т. е. максимальное значение энтропии системы с конечным числом состояний равно логарифму числа состояний и достигается, когда все состояния равновероятны.

Вычисление энтропии по формуле (18.2.2) можно несколько упростить, если ввести в рассмотрение специальную функцию:

![]() , (18.2.9)

, (18.2.9)

где логарифм берется по основанию 2.

Формула (18.2.2) принимает вид:

. (18.2.10)

. (18.2.10)

Функция затабулирована; в приложении (табл. 7) приведены ее значения для от 0 до 1 через 0,01.

Пример 1. Определить энтропию физической системы, состоящей из двух самолетов (истребителя и бомбардировщика), участвующих в воздушном бою. В результате боя система может оказаться в одном из четырех возможных состояний:

1) оба самолета не сбиты;

2) истребитель сбит, бомбардировщик не сбит;

3) истребитель не сбит, бомбардировщик сбит;

4) оба самолета сбиты.

Вероятности этих состояний равны соответственно 0,2; 0,3; 0,4 и 0,1.

Решение. Записываем условия в виде таблицы:

Пролог 113. Смысл принципа максимума энтропии

Степенные распределения могут возникать в результате действия принципа максимума энтропии - мы убедились в этом в Прологе 111 и в Прологе 112 описали построенную на этой основе модель мультипликативных коллизий, которая развивает степенное распределение на некотором множестве объектов.

Однако, чтобы адекватно применить эту модель для объяснения происхождения степенных распределений, которые наблюдаются в различных природных и человеческих системах, необходимо внимательно приглядеться к двум ее основаниям - к принципу максимума энтропии и к мультипликативности взаимодействий. Мы попробуем вдуматься в их "философское" значение. Начнем по порядку, с принципа максимума энтропии.

Две трактовки принципа максимума энтропии

В такой трактовке принцип максимума энтропии очевидно перекликается со вторым началом термодинамики - фундаментальным законом физики, в соответствии с которым энтропия замкнутой системы может либо нарастать либо оставаться неизменной, но не уменьшаться. Из этого прямо следует, что если мы возьмем любую замкнутую систему, которая оставалась таковой достаточно длительное время, то мы обнаружим ее в состоянии с максимальной энтропией.

Однако исторически принцип максимума энтропии ведет свою родословную совершенно из другого источника - не из термодинамики, а из теории вероятностей. И именно этот источник дает вторую трактовку принципа максимума энтропии, вероятно более фундаментальную. Ее можно сформулировать так: из всех гипотез о форме распределения случайной величины следует выбирать ту, при которой энтропия распределения максимальна, с учетом ограничений, накладываемых нашими знаниями о системе .

В начале 18-го века Якоб Бернулли, раздумывая над основаниями теории вероятностей, сформулировал "Принцип недостаточной причины", который и считается предтечей принципа максимума энтропии. Пусть мы рассматриваем два альтернативных и взаимоисключающих исхода A и B . Принцип Бернулли гласит, что если у нас нет никакой информации о вероятностях этих исходов, их следует полагать равновероятными. То есть, у нас в этих условиях недостаточно причин назначить одному из исходов более высокую вероятность, чем другому. Заметим, что с позиций Бернулли вероятности отражают наши знания о предмете. Если у нас о нем нет никаких знаний (кроме того, что возможно два исхода), вероятности должны быть положены равными. У любого другого распределения вероятностей должно быть основание, причина, основанная на нашем знании законов, управляющих предметом.

Итак, каждый исход следует предполагать равновероятным, если нет оснований для иного выбора. Если различными исходами являются различные значения некоторой величины, мы должны принимать однородное распределение вероятностей. Как мы знаем, именно однородное распределение обладает максимальной энтропией. Но Бернулли не говорил об энтропии - он жил и работал за два века до того, как появилось это понятие. Чтобы прийти от принципа недостаточной причины к принципу максимума энтропии, нужно было сделать немало шагов - и этот путь был пройден до конца только к середине 20-го века, а последние шаги связываются с работами американского физика Эдвина Джейнса.

От принципа недостаточной причины - к принципу максимума энтропии

Однако мы, вооруженные современными понятиями, можем пройти этот путь гораздо быстрее, напрямую. Он кажется очень простым - но только с высоты наших нынешних знаний. И тем не менее, именно Бернулли мог стать первооткрывателем и принципа максимума энтропии и самого исчисления энтропии/информации. Мог бы, если бы немного больше верил в описательную способность чисел - а в нее он, безусловно верил, ведь не даром стал одним из основателей теории вероятностей.

Итак, когда мы имеем два альтернативных исхода A и B, и более неизвестно ничего, принцип недостаточной причины требует предполагать их равновероятность: p A =p B =1/2. Именно так мы привносим минимум каких-то предубеждений в свои предположения о вероятности исходов. Предположим, что существует какая-то функция от этих вероятностей H(p A ,p B) , которая оказывается максимальной в том случае, если p A =p B =1/2 (или мы могли бы принять, что она в этих условиях наоборот, минимальна - это не принципиально). Обозначим этот минимум как H(1/2,1/2) . Можем ли мы что-то сказать большее об этой функции исходя из общих соображений?

Вполне, и Якоб Бернулли был мастером в таких вещах . Во-первых, заметим, что если у нас имеется только один возможный исход A, он автоматически имеет вероятность, равную единице. Это значит, что не существует никаких знаний, которые мы могли бы привнести дополнительно и которые могли бы повлиять на нашу оценку вероятности исхода. То есть, мы обладаем абсолютно полным знанием об исходе. В этом случае разумно ожидать, что наша функция, отражающая количество привнесенных нами в оценку исходов знаний принимает минимальное значение, скажем, нулевое: H(1) = 0.

Далее, заметим, что когда ситуация из двух равновероятных альтернатив разрешается тем или иным образом, мы оказываемся в ситуации с одним возможным исходом - с тем, который выбрал случай. Что происходит в этот момент с функцией H ? Она уменьшается от значения H(1/2,1/2) до значения H(1) = 0. Эту разность: H(1/2,1/2) -H(1) = H(1/2,1/2) резонно счесть количеством знаний, которые мы приобрели относительно двух равновероятных исходов, когда альтернатива разрешилась. Или, иначе, количеством не-знания или неопределенности в изначальной ситуации с двумя равновероятными исходами. На современном языке это количество именуется энтропией.

Пусть теперь мы знаем, что может быть четыре исхода A,B,C,D и более ничего. Принцип недостаточной причины требует, чтобы мы также назначили им равные вероятности p A =p B =p C =p D =1/4. Но чему равно знaчение функции H(p A ,p B ,p С,p D) в этом случае? Элементарная логика приводит к выводу, что ее значение должно быть в два раза больше, чем для случая двух возможных равновероятных исходов: 2*H(1/2,1/2) . Действительно, пусть исходы A, B c одной стороны и C,D c другой стороны очень похожи. Если мы не очень внимательны или не очень зорки, мы их можем не различить между собой. Тогда мы возвращаемся к случаю с двумя исходами и неопределенность ситуации равна H(1/2,1/2) . Но мы пригляделись внимательно и увидели, что на самом деле там, где мы видели один исход на самом деле есть два близких. Перед нами вновь возникает задача выбора самого "честного" распределения вероятностей между ними, и им вновь окажется равномерное распределение. И к неопределенности прибавляется еще H(1/2,1/2) . Значит для ситуации с четырьмя равновероятными альтернативами H(1/4,1/4,1/4,1/4) = 2*H(1/2,1/2) . Индуктивно продолжая, мы бы установили, что для ситуации с восемью исходами количество неопределенности равно 3*H(1/2,1/2) , и т.д.

Полагаю, читатель понимает, что наш вывод свойств функции H совпадает с логикой, приводящей к уравнению количества информации/энтропии по Хартли . Если обозначить количество равновероятных исходов как N , энтропия по Хартли равна

Мы знакомились с простой тропинкой , которая ведет от формулы Хартли к формуле Шеннона - Якоб Бернулли ее легко бы обнаружил. А получи Бернулли в свое распоряжение эту формулу, он мог бы количественно оценивать степень неопределенности некоторого распределения вероятностей и установить принцип, в соответствии с которым мы должны наделять исходы вероятностями так, чтобы энтропия распределения была максимальной из всех допустимых - это и есть принцип максимума энтропии.

Впрочем, история не знает сослагательных наклонений, а у науки своя неспешная поступь.

В заключение стоит заметить, что ключевым шагом является самый первый, в котором мы полагаем существование некоторой функции H , достигающей максимума при равновероятных исходах. Все остальное раскатывается как клубок. Это лишнее подтверждение пользы экстремальных принципов , когда мы считаем какое-то обычное или правильное состояние системы таким, в котором некоторая функция ее состояния достигает экстремального значения.

Главная интрига принципа максимума энтропии заключается в том, что он имеет две трактовки (проистекающие из двух разных источников), которые даже с первого взгляда коренным образом различаются по смыслу. В трактовке, ведущей свою историю от принципа Бернулли, речь идет о правиле организации наших описаний мира . Мы должны описывать мир так, чтобы не навязывать ему своих предубеждений, выражающихся в назначении различным событиям неоправданных вероятностей. Всякий раз следует выбирать такое описание, в котором нет ничего кроме того, что нам достоверно известно. Это эвристическое правило, позволяющее избегать искажений в описаниях реальности.

Физическая трактовка, с помощью которой мы, в частности, можем вывести распределение энергий молекул идеального газа, говорит о чем-то другом. Она задает правила, управляющие не нашим описанием реальности, а самой реальностью . Если физическая система управляется каким-то законом и ничем иным, то распределение параметров в ней 1) будет отвечать этому закону и 2) будет иметь максимальную энтропию среди разрешенных распределений. Это утверждение не о том, как нам лучше описывать мир, а о самом мире .

Когда в Манифесте когнитивиста говорится о том, что устройство мира соответствует устройству нашего сознания, речь идет именно об этих поразительных "совпадениях": лучший выбор при построении наших описаний мира является также и лучшим выбором самой природы.

На это можно возразить, что принцип Бернулли позволяет получать более правдоподобные описания реальности, и только поэтому он может считаться верным. Однако, Бернулли вывел его вовсе не эмпирически, не сравнивая его с реальностью. Он выдвинул его исходя из требований логики, исходя из свойств самого разума и его абстрактных построений. (Более того, он осознавал большую проблему с практической ценностью своего принципа в его исходном виде - только в очень редких обстоятельствах в природных явлениях можно видеть исходы с равными вероятностями.) Но оказывается, мир подчинен той же логике, и будто несет в себе такой же разум, как и наш собственный.

Мы лучше оценим эту удивительную двойственность принципа максимума энтропии, сопоставив его с одним идейно близким принципом, которому не повезло быть настолько же хорошо сформулированным. Мы попробуем это исправить.

Бритва Оккама и принцип минимума сложности

Близким родственником принципа недостаточной причины является знаменитая бритва Оккама. Это правило, которое предлагает нам среди альтернативных описаний мира предпочитать самое простое, содержащее в себе минимальное число сущностей и параметров. Переформулируя эту эвристику, родственность двух принципов легко разглядеть: среди всех альтернативных описаний следует выбирать содержащее в себе минимум структурной или алгоритмической сложности . Речь идет о том, что следует выбирать модель или описание, обладающее самым простым алгоритмом. "Алгоритмическая сложность" - это не фигура речи, это исчислимая величина, имеющая прямое отношение к энтропии/информации. Ее также называют алгоритмической энтропией или колмогоровской сложностью по имени русского математика А. Н. Колмогорова, который ввел эту величину в научный обиход. Колмогоровская сложность некоторой строки символов измеряется как длина программы или алгоритма, необходимого для того, чтобы воспроизвести эту строку. Чем сложнее организована строка символов, тем длиннее программа, которая нужна для ее воспроизведения. Разумеется, длина программы зависит от языка программирования, однако, этим фактором можно пренебречь, положив, что мы пишем программы на каком-то идеальном, самом экономичном и лаконичном языке.

Пусть, например, следующая запись на этом идеальном языке означает взять строку "AB" и повторить ее 10 раз:

Можно сказать, что алгоритмическая сложность этой строки равна 5 символам - именно такую длину имеет порождающая эту строку кратчайшая программа.

Еще пример: данная строка из 20 символов имеет алгоритмическую сложность в 12 символов, потому что именно такую длину имеет генерирующая ее программа:

Обратим внимание на важный момент: это бессистемная строка символов в том смысле, что мы в ней не видим системы, которая бы позволила сократить алгоритм. Но это не значит, что это случайная последовательность символов. Если нам нужно воспроизвести именно случайную последовательность, нам следует воспользоваться другой программой:

Это парадоксально: кажется полностью случайная строка имеет ту же самую сложность, что и полностью упорядоченная. Но на самом деле предельно высокой сложностью обладает не однородная строка и не случайная строка, а бессистемная строка, которая является совершенно не случайной, а наоборот, предельно закономерной. Это легко понять: вообразим, что мы наугад тыкаем в раскрытую книгу пальцем и всегда попадаем на одно и то же слово. Ясно, что эта ситуация коренным образом отличается от той, когда мы попадаем совершенно случайно в разные слова. Важность этого нюанса мы увидим чуть далее.

Отметим, что несмотря на казалось бы совершенно отдаленное отношение сложности по Колмогорову к энтропии по Шеннону и Хартли, в действительности можно показать их глубокую взаимосвязь - но мы тут не будем вдаваться в эту тему.

Итак, мы можем смотреть на некоторую модель или описание как на алгоритм, воспроизводящий требуемый набор свойств (требуемую "строку"). Тогда бритва Оккама требует выбирать описание, обладающее минимальной алгоритмической энтропией.

Исторический сюжет, который может послужить примером ситуации, в которой этот принцип оказался бы полезен - противостояние систем Птолемея и Коперника. Система Птолемея - это модель мироздания, основанная на наивно-религиозном убеждении в том, что в центре вселенной должна находиться Земля:

|

Вокруг Земли вращаются по орбитам небесные светила, в том числе и Солнце. Однако, при идейной правильности такой конструкции, она имела некоторый недостаток: в ее рамках было нельзя объяснить феномен смены направления движения планет по небесному своду. Скажем, Юпитер в течение нескольких недель поступательно передвигается относительно звезд. Но затем он совершает петлю и некоторое время движется в обратную сторону. Затем возвращается к "правильному" движению. Чтобы объяснить это явление Птолемей ввел в свою систему так называемые эпициклы - он предположил, что кроме вращения вокруг Земли каждое светил дополнительно вращается по небольшой орбите вокруг некоторого центра, который в свою очередь и вращается вокруг Земли по круговой орбите. Тогда те моменты, когда Юпитер двигается по своему эпициклу назад, мы видим смену направления его движения по небосводу.

Коперник предложил другую систему: в ней в центре находится Солнце (читатель наверное наслышан). Система Коперника смогла объяснить петли Юпитера и других светил без введения эпициклов, было достаточно простого кругового движения планет, чтобы мы с Земли иногда видели петли в движении планет. Даже не вдаваясь в точность предсказаний движения планет по небесному своду, система Коперника, очевидно, обладает меньшей алгоритмической сложностью, и при этом способна "воспроизвести правильную строку". Таким образом, если руководствоваться принципом Оккама, нам следует предпочесть именно систему Коперника.

Но есть ли у бритвы Оккама свой аналог в свойствах самой реальности как он есть у принципа недостаточной причины? Автор уверен в положительном ответе. Попробуем его сформулировать, назовем его принципом минимальной структурной сложности : система, потенциально способная обладать различной структурой имеет структуру, обладающую минимальной сложностью по Колмогорову с учетом внешних требований к свойствам этой системы .

Вот здесь и оказывается важно различие между случайными строками и предельно закономерными. Документируя положение и скорости молекул в сосуде с газом, мы каждый раз будем получать набор цифр, близкий к случайному - "случайную строку". Но если бы мы каждый раз получали бы один и тот же результат, это бы говорило о том, что система находится в предельно структурно сложном состоянии.

Отметим, что есть очень важный для нас пример структур, обладающих низкой алгоритмической сложностью: фракталы развиваются в результате повторения одних и тех же генерирующих преобразований, применяемых к разным масштабным уровням. Алгоритмически это простые структуры. Может быть, принцип минимальной структурной сложности способен объяснить такую всеобъемлющую распространенность фрактальных структур в различных явлениях мира.

Впрочем, это пока лишь смутная идея.

Далее, мы видели, как принцип максимума энтропии связан со вторым началом термодинамики. Но может быть, принцип минимума структурной сложности подсказывает нам еще одно следствие второго начала. Его можно сформулировать так: если в исходный момент времени структура системы не является наименее сложной, она эволюционирует в строну уменьшения сложности, достигая возможного минимума .

Если эта трактовка второго начала термодинамики верна, возникает вопрос, адресованный к его обычному толкованию: если энтропия мира как системы только увеличивается, почему вселенная еще не пришла в состояние максимума энтропии (и минимума структурной сложности), который именуют "тепловой смертью"? Наука не может ответить на этот вопрос. Может быть - к этому ответу склоняются материалисты - еще не успела. А может быть, наша вселенная - не закрытая, а открытая система и откуда-то получает ресурс, позволяющий ей справляться со вторым началом термодинамики. Этого мнения придерживаются идеалисты, к числу которых себя причисляет и автор. У нас пока не достаточно знаний, чтобы поставить точку в этой дилемме.

Завершим этот Пролог тем, что "разделим шкуру не убитого медведя" и восхитимся тем, что бритва Оккама не только способна отсекать все лишнее от наших умопостроений, но и отсекает все лишнее от структуры мира, так что он предстает перед нами в простейшем, самом элегантном облике из всех возможных. Как тут не вспомнить Лейбница, который полагал, что мы живем в лучшем из возможных миров?

Энтропия определяется как среднее значение собственной информации ансамбля

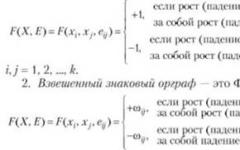

Метод максимума энтропии, аналогично методу максимума информации, строится на поиске среди всех возможных распределений вероятностей такого, которое обладает максимальной энтропией вида (3.19). Таким образом, критерий максимума энтропии используется для снятия неопределенности решения, а функционал (3.19) выступает как своеобразная «мера качества» изображения .

Смысл такой меры качества можно понять, обратившись к задаче оценивания плотностей распределения вероятностей в математической статистике. В случае известных моментов случайного распределения оценка, получаемая максимизацией выражения (3.19), является наименее смещенной из всех возможных оценок. Можно ожидать, что максимум (3.19) при наложенных ограничениях на процесс формирования изображения будет давать хорошую оценку плотности распределения. Попытаемся рассмотреть процесс формирования изображения и выяснить физический смысл критерия максимума энтропии.

Пусть суммарная интенсивность источника равна причем из точки излучается интенсивность из Подсчитаем число способов, которыми данный объект может быть сформирован из лучей:

Теперь найдем такое распределение, которое будет сформировано в наибольшем числе случаев

Заменив на его логарифм (максимум при этом не сместится) и используя формулу Стирлинга, получим :

Для решения задачи необходимо учесть также ограничения на уравнения формирования:

а также ограничение на суммарную интенсивность изображения, т. е.

Выражения составляют основу метода максимума энтропии. Физический смысл применения критерия максимума энтропии заключается в поиске такого распределения вероятностей на входе канала, которое в большинстве случаев формирует заданное выходное распределение или поиск наиболее правдоподобного распределения источника при заданных условиях формирования. В этом смысле метод максимума энтропии можно рассматривать как метод максимального правдоподобия для лучевой модели формирования изображений .

Рассмотрим одну из наиболее часто встречающихся форм записи метода максимума энтропии. Будем рассматривать одновременно с формированием изображения параллельное формирование шумового поля :

На основании приведенных рассуждений получим, что шумовое поле может быть создано способами, где

Для решения задачи необходимо максимизировать совместную вероятность формирования изображения и шумового поля

Логарифмирование этого выражения дает сумму энтропий шума и изображения:

Учитывая ограничения на процесс формирования и сохранение числа лучей (суммарную интенсивность), получим следующую задачу оптимизации:

где величины и являются множителями Лагранжа задачи оптимизации. Для решения системы найдем частные производные (3.25) по и приравняем их к нулю:

Подставляя выражения для и из (3.26), (3.27) в уравнения ограничений, находим

Из уравнений вида (3.28) определяются множители Лагранжа которые используются для нахождения функции входного распределения:

Экспонента в (3.29) обеспечивает положительность решения Сам функционал энтропии существенно нелинеен, что обусловливает интересную особенность уравнений (3.29): они могут содержать пространственные частоты, которые отсутствовали в спектре искаженного изображения. Это позволяет говорить о возможности «сверхразрешения», т. е. восстановлении информации, уничтоженной системой формирования с ограниченной полосой (эффекту сверхразрешения и оценке его возможностей посвящена гл. 5). Отметим также, что решения, получаемые на основе (3.29), обладают повышенным качеством по сравнению с линейными алгоритмами восстановления, однако требуют решения сложной системы нелинейных уравнений.

Выражению для энтропии в форме (3.19) существует альтернатива, предложенная Бургом для оценок спектров мощности . Эта форма энтропии имеет следующий вид:

Метод восстановления на основе выражения (3.30) также можно использовать в практике обработки изображений. Пусть нам известны зашумленные отсчеты спектра

где соответственно отсчеты спектров Наложим ограничение на расхождение истинных и зашумленных отсчетов спектра наблюдаемого изображения :

Тогда для нахождения решения требуется максимизировать более простой функционал:

Необходимо отметить, что в последнее время появилось большое число алгоритмов на основе как (3.19), так и (3.30), использующих при этом самые разнообразные ограничения, вытекающие из постановки каждой конкретной задачи. Правда, наличие двух норм энтропии вызывает некоторое сомнение, во-первых, из-за того, что неясно, какую из них использовать на практике, а во-вторых, из-за недостаточно четкой постановки задачи восстановления.

Существует еще одна интересная особенность алгоритмов, основанных на поиске максимума энтропии. Обратимся к выражениям (3.27)-(3.29) для случая идеальной системы формирования, но при наличии аддитивного шума Нетрудно видеть, что применение алгоритма максимума энтропии в этом случае претендует на выделение изображения из шума без каких-либо априорных характеристик шума и сигнала. Однако более внимательный анализ показывает, что решение с помощью уравнений вида (3.28) дает парадоксальный результат: сигнал и шум оказываются связаны линейной зависимостью. Действительно, оценка сигнала здесь равна

а оценка шума будет:

В практических приложениях для избежания этого эффекта выражение для энтропии шума берут с некоторым весовым коэффициентом и вместо (3.24) рассматривают следующий функционал:

Этот прием, однако, оставляет неясным физический смысл производных преобразований.

Еще один недостаток метода максимума энтропии состоит в том, что наилучшие результаты с его помощью получаются при восстановлении объектов, состоящих из отдельных импульсов на однородном фоне, а попытки применения метода к пространственно протяженным объектам вызывают появление флуктуаций .

Изложенные результаты, касающиеся методов максимума энтропии и максимума информации, могут быть объединены

в единую схему, основанную на построении алгоритмов оценивания плотности распределения с помощью метода максимального правдоподобия. Тем самым рассмотренные алгоритмы можно включить в группу методов статистической регуляризации, описанных в § 2.4. Отличие лишь в том, что эти алгоритмы основаны на другой статистической модели - представлении самого изображения как плотности вероятности. Такая модель сразу же приводит к нелинейности рассматриваемых функционалов . Однако отмеченные ранее недостатки заставляют искать алгоритмы, которые, сохраняя преимущества теоретико-информационных методов восстановления (неограниченность по полосе частот, неотрицательность решения и т. п.), позволяют восстанавливать более широкий класс изображений.

Игра в бильярд начинается с того, что шары аккуратной пирамидкой выстраиваются на столе. Затем наносится первый удар кием, который разбивает пирамиду. Шары перекатываются по столу по причудливым траекториям, многократно сталкиваются со стенками стола и друг с другом и, наконец, застывают в некотором новом расположении. Отчего-то новое расположение всегда менее упорядоченно. Почему? Можно пробовать бесконечно. Положения шаров на столе каждый раз будут меняться, но никогда мы не придем к такой же упорядоченной пирамиде, которая была на столе перед первым ударом. Система самопроизвольно переходит в менее упорядоченные состояния. Никогда не в более упорядоченные. Для того чтобы система перешла в упорядоченное состояние, необходимо вмешательство извне. Кто-нибудь из играющих берет треугольную рамку и формирует новую пирамиду. Процесс требует вложения энергии. Не существует способа заставить шары самопроизвольно выстроиться в пирамиду в результате соударений друг с другом и со стенками.

Процесс нарастания беспорядка на бильярдном столе не управляется (хотя и требует энергии для своего прохождения), потому что хороший бильярдный стол специально делается таким, чтобы энергия шара в любой его точке была одинаковой. То, что происходит на бильярдном столе, демонстрирует другой великий принцип, по которому организована наша Вселенная: принцип максимума энтропии. Разумеется, одним лишь бильярдным столом великий принцип мироздания не ограничивается. Так что будем разбираться.

Энтропия - это мера неупорядоченности системы. Чем меньше порядка в системе, тем выше ее энтропия. Наверное, имеет смысл поговорить о том, что считать порядком и что беспорядком.

Под порядком можно понимать регулярное расположение частиц, когда расстояния и направления повторяются, а по расположению нескольких частиц можно предсказать расположение следующей. Если частицы равномерно перемешаны безо всякого видимого закона расположения - это беспорядок. Если частицы аккуратно собраны в одной области пространства - это порядок. Если разбросаны повсюду - беспорядок. Если разные компоненты смеси находятся в разных местах - это порядок. Если все вперемежку - беспорядок. В общем, спросите маму или жену - она объяснит.

Энтропия газа (между прочим, слово "газ" - это искаженное греческое "хаос") выше, чем жидкости. Энтропия жидкости выше, чем твердого тела. Вообще говоря, повышение температуры увеличивает беспорядок. Из всех состояний вещества наименьшую энтропию будет иметь твердый кристалл при температуре абсолютного нуля. Эту энтропию принимают за нулевую.

В различных процессах энтропия изменяется. Если в некотором процессе не происходит изменения энергии, то процесс протекает самопроизвольно только в том случае, если это ведет к повышению энтропии системы. (Что происходит, когда меняется и энтропия, и энергия, мы обсудим немного позже.) Именно поэтому после удара кием шары на бильярдном столе переходят в менее упорядоченное положение. Изменения энтропии в различных системах можно суммировать в виде принципа максимума энтропии :

Любая система самопроизвольно стремится занять наиболее неупорядоченное доступное ей состояние.

Очень часто это же самое формулируется в виде принципа неуменьшения энтропии :

Энтропия изолированной системы не может уменьшиться.

Эта формулировка породила и порождает продолжать массу споров на тему тепловой смерти Вселенной: Вселенная по определению является изолированной системой (поскольку у нее отсутствует окружающая среда, с которой был бы возможен обмен массой или энергией), следовательно, ее энтропия постепенно возрастает. Следовательно, Вселенная придет в конце концов в состояние полной однородной неупорядоченности, в котором не может существовать ни один объект, как-то отличающийся от окружения. Тема в высшей степени увлекательная, но давайте об этом как-нибудь в другой раз.